Nightshade を使用してアートワークを生成 AI から保護する方法

AI ツールは革新的で、会話を行ったり、人間のようなテキストを生成したり、単一の単語に基づいて画像を作成したりできるようになりました。ただし、これらの AI ツールが使用するトレーニング データは、特に DALL-E、Midjourney などのテキストから画像へのジェネレーターに関しては、著作権で保護されたソースから取得されていることがよくあります。

トレーニングに著作権画像を使用する生成 AI ツールを止めるのは難しく、あらゆる分野のアーティストが AI トレーニング データセットから作品を保護するのに苦労しています。しかし今、生成 AI ツールの出力を妨害するために構築された無料の AI ツールである Nightshade の出現により、すべてが変わりました。そして最終的にアーティストが力を取り戻せるようになりました。

AI ポイズニングとは何ですか?

AI ポイズニングは、AI アルゴリズムのトレーニング データセットを「ポイズニング」する行為です。これは、AI に意図的に間違った情報を与え、その結果、学習済みの AI が誤動作したり、画像を検出できなくなったりすることに似ています。 Nightshade のようなツールは、AI トレーニングとは完全に異なるように見えるが、人間の目には元の画像とほとんど変わらないようにデジタル画像内のピクセルを変更します。

たとえば、毒を盛った車の画像をインターネットにアップロードすると、人間には同じように見えますが、AI は車の画像を見て車を識別するよう自らを訓練しようとします。インターネットではまったく異なるものが表示されます。

AI のトレーニング データに含まれるこれらの偽の画像や汚染された画像のサンプル サイズが十分に大きいと、AI のオブジェクトの理解が損なわれ、特定のプロンプトから正確な画像を生成する機能が損なわれる可能性があります。

生成 AI の将来がどうなるかについてはまだいくつかの疑問がありますが、オリジナルのデジタル作品を保護することは間違いなく優先事項です。モデルの基礎を構築するトレーニング データが 100% 正しくないため、これによりモデルの将来の反復に損害を与える可能性さえあります。

この技術を使用すると、AI データセットでの画像の使用に同意していないデジタル クリエイターは、その画像が許可なく生成 AI にフィードされるのを防ぐことができます。一部のプラットフォームでは、クリエイターが AI トレーニング データセットにアートワークを含めないようにオプトアウトするオプションが提供されています。ただし、このようなオプトアウト リストは、AI モデル トレーナーによって過去にも無視されており、今後も無視され続けますが、ほとんど影響はありません。

Glaze のような他のデジタル アートワーク保護ツールと比較すると、Nightshade は攻撃的です。 Glaze は AI アルゴリズムが特定の画像のスタイルを模倣するのを防ぎますが、Nightshade は画像の外観を AI に変更します。どちらのツールも、シカゴ大学のコンピューター サイエンス教授である Ben Zhao によって構築されました。

Nightshade の使用方法

このツールの作成者は、Nightshade を Glaze と一緒に使用することを推奨していますが、アートワークを保護するためのスタンドアロン ツールとしても使用できます。 Nightshade で画像を保護する手順が 3 つだけであることを考えると、このツールの使用も非常に簡単です。

ただし、開始する前に留意する必要があることがいくつかあります。

Nightshade は Windows および MacOS でのみ利用できますが、GPU サポートには制限があり、最低 4GB VRAM が必要です。現時点では、Nvidia 以外の GPU と Intel Mac はサポートされていません。 Nightshade チームによるサポートされている Nvidia GPU のリストは次のとおりです (GTX および RTX GPU は「CUDA 対応の GeForce および TITAN 製品」セクションにあります)。あるいは、CPU 上で Nightshade を実行することもできますが、パフォーマンスが低下します。 GTX 1660、1650、または 1550 を使用している場合、PyTorch ライブラリのバグにより、Nightshade を適切に起動または使用できない可能性があります。 Nightshade の背後にあるチームは、PyTorch から Tensorflow に移行することで将来この問題を修正する可能性がありますが、現時点では回避策はありません。この問題は、これらのカードの Ti バージョンにも及びます。 Windows 11 PC に管理者アクセスを提供してプログラムを起動し、プログラムが開くまで数分間待ちました。走行距離は異なる場合があります。 アートワークに固体の形状や背景がたくさんある場合、アーティファクトが発生する可能性があります。これは、より強度の低い「中毒」を使用することで対抗できます。Nightshade で画像を保護する場合、次のことを行う必要があります。このガイドでは Windows バージョンを使用していますが、これらの手順は macOS バージョンにも適用されることに注意してください。

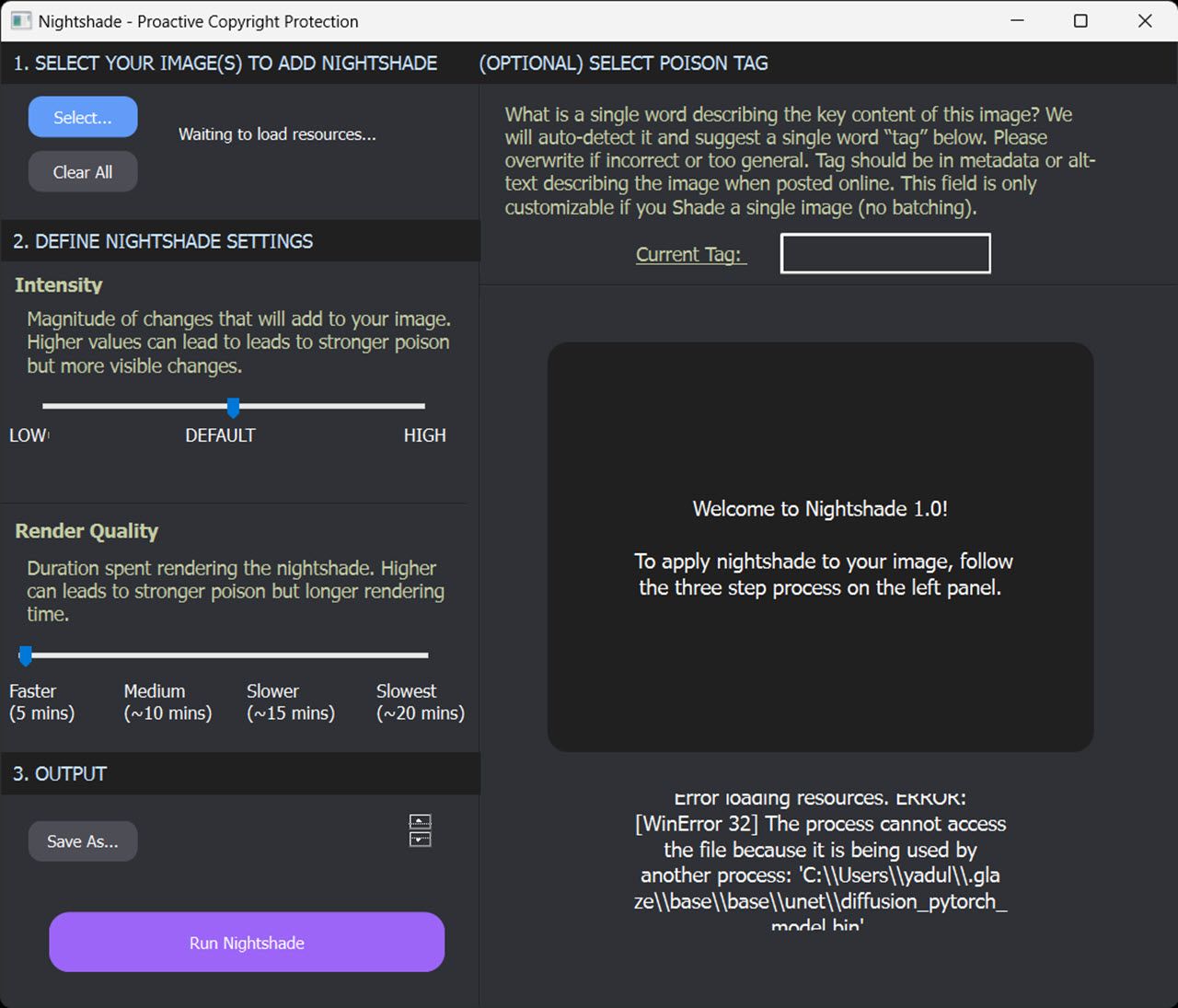

Nightshade ダウンロード ページから Windows または macOS バージョンをダウンロードします。 Nightshade はアーカイブ フォルダーとしてダウンロードされ、インストールは必要ありません。ダウンロードが完了したら、ZIP フォルダーを解凍し、Nightshade.exe をダブルクリックしてプログラムを実行します。 左上の「選択」ボタンをクリックして、保護したい画像を選択します。一度に複数の画像を選択してバッチ処理することもできます。 好みに応じて強度とレンダリング品質のダイヤルを調整します。値を高くするとポイズニングが強化されますが、出力イメージにアーティファクトが発生する可能性もあります。 次に、「出力」セクションの下にある「名前を付けて保存」ボタンをクリックして、出力ファイルの保存先を選択します。 下部にある「Run Nightshade」ボタンをクリックしてプログラムを実行し、画像を汚染します。

好みに応じて強度とレンダリング品質のダイヤルを調整します。値を高くするとポイズニングが強化されますが、出力イメージにアーティファクトが発生する可能性もあります。 次に、「出力」セクションの下にある「名前を付けて保存」ボタンをクリックして、出力ファイルの保存先を選択します。 下部にある「Run Nightshade」ボタンをクリックしてプログラムを実行し、画像を汚染します。 オプションで、毒タグを選択することもできます。 Nightshade は、単一の単語タグを自動的に検出して提案します (そうでない場合)。ただし、それが間違っていたり一般的すぎる場合は変更できます。この設定は、Nightshade で 1 つの画像を処理する場合にのみ使用できることに注意してください。

すべてがうまくいけば、人間の目には元の画像と同じに見えますが、AI アルゴリズムからはまったく異なる画像が得られるはずです。これにより、生成 AI からアートワークが保護されます。

-

AIエージェントとは何ですか? - 分析とアプリケーションガイドArtificial Intelligence (AI) is rapidly evolving, and 2025 is shaping up to be the year of AI agents. But what are AI agents...AI 2025-05-01に投稿

AIエージェントとは何ですか? - 分析とアプリケーションガイドArtificial Intelligence (AI) is rapidly evolving, and 2025 is shaping up to be the year of AI agents. But what are AI agents...AI 2025-05-01に投稿 -

PythonのOpenCVとRoboflowによる性別検出-AnalyticsVidhya導入 フェイシャル画像からのジェンダー検出は、コンピュータービジョンの多くの魅力的なアプリケーションの1つです。このプロジェクトでは、OpenCVを対立する場所と性別分類のためにRoboflow APIを組み合わせて、顔を識別し、それらをチェックし、性別を予測するデバイスを作成します。この直接は、コ...AI 2025-04-29に投稿されました

PythonのOpenCVとRoboflowによる性別検出-AnalyticsVidhya導入 フェイシャル画像からのジェンダー検出は、コンピュータービジョンの多くの魅力的なアプリケーションの1つです。このプロジェクトでは、OpenCVを対立する場所と性別分類のためにRoboflow APIを組み合わせて、顔を識別し、それらをチェックし、性別を予測するデバイスを作成します。この直接は、コ...AI 2025-04-29に投稿されました -

最初のマシン思考:戦略的AIの台頭STRATEGIC AI Prologue 11. May 1997, New York City. It was a beautiful spring day in New York City. The skies were clear, and temperatures were climbin...AI 2025-04-29に投稿されました

最初のマシン思考:戦略的AIの台頭STRATEGIC AI Prologue 11. May 1997, New York City. It was a beautiful spring day in New York City. The skies were clear, and temperatures were climbin...AI 2025-04-29に投稿されました -

8 LLMの本質的な無料および有料API推奨事項LLMSの力の活用:大規模な言語モデルのAPIのガイド 今日のダイナミックなビジネスランドスケープでは、API(アプリケーションプログラミングインターフェイス)がAI機能の統合と利用方法に革命をもたらしています。 それらは重要な橋として機能し、大規模な言語モデル(LLM)を多様なソフトウェアエコ...AI 2025-04-21に投稿されました

8 LLMの本質的な無料および有料API推奨事項LLMSの力の活用:大規模な言語モデルのAPIのガイド 今日のダイナミックなビジネスランドスケープでは、API(アプリケーションプログラミングインターフェイス)がAI機能の統合と利用方法に革命をもたらしています。 それらは重要な橋として機能し、大規模な言語モデル(LLM)を多様なソフトウェアエコ...AI 2025-04-21に投稿されました -

ユーザーガイド:FALCON 3-7B指示モデルTIIのファルコン3:オープンソースの革新的な飛躍ai TIIのAIの再定義の野心的な追求は、Advanced Falcon 3モデルで新たな高みに達します。 この最新のイテレーションは、新しいパフォーマンスベンチマークを確立し、オープンソースAIの機能を大幅に進めます。 Falcon 3...AI 2025-04-20に投稿しました

ユーザーガイド:FALCON 3-7B指示モデルTIIのファルコン3:オープンソースの革新的な飛躍ai TIIのAIの再定義の野心的な追求は、Advanced Falcon 3モデルで新たな高みに達します。 この最新のイテレーションは、新しいパフォーマンスベンチマークを確立し、オープンソースAIの機能を大幅に進めます。 Falcon 3...AI 2025-04-20に投稿しました -

deepseek-v3対gpt-4oおよびllama 3.3 70b:明らかにされた最強のAIモデルThe evolution of AI language models has set new standards, especially in the coding and programming landscape. Leading the c...AI 2025-04-18に投稿されました

deepseek-v3対gpt-4oおよびllama 3.3 70b:明らかにされた最強のAIモデルThe evolution of AI language models has set new standards, especially in the coding and programming landscape. Leading the c...AI 2025-04-18に投稿されました -

トップ5 AIインテリジェントな予算編成ツールAIで金融の自由のロックを解除:インドのトップ予算編成アプリ あなたはあなたのお金がどこに行くのか絶えず疑問に思ってうんざりしていますか? 法案はあなたの収入をむさぼり食うようですか? 人工知能(AI)は強力なソリューションを提供します。 AI予算編成ツールは、リアルタイムの財務洞察、パーソナ...AI 2025-04-17に投稿されました

トップ5 AIインテリジェントな予算編成ツールAIで金融の自由のロックを解除:インドのトップ予算編成アプリ あなたはあなたのお金がどこに行くのか絶えず疑問に思ってうんざりしていますか? 法案はあなたの収入をむさぼり食うようですか? 人工知能(AI)は強力なソリューションを提供します。 AI予算編成ツールは、リアルタイムの財務洞察、パーソナ...AI 2025-04-17に投稿されました -

Excel Sumproduct機能の詳細な説明 - データ分析学校Excelの等式関数:データ分析Powerhouse 合理化されたデータ分析のためのExcelの等式関数の力のロックを解除します。この汎用性のある関数は、合計と乗算機能を簡単に組み合わせて、対応する範囲または配列全体の追加、減算、および分割に拡張します。 傾向を分析するか、複雑な計算に取り組む...AI 2025-04-16に投稿されました

Excel Sumproduct機能の詳細な説明 - データ分析学校Excelの等式関数:データ分析Powerhouse 合理化されたデータ分析のためのExcelの等式関数の力のロックを解除します。この汎用性のある関数は、合計と乗算機能を簡単に組み合わせて、対応する範囲または配列全体の追加、減算、および分割に拡張します。 傾向を分析するか、複雑な計算に取り組む...AI 2025-04-16に投稿されました -

詳細な調査は完全にオープンで、ChatGptとユーザーの利点がありますOpenaiの深い研究:AI研究のためのゲームチェンジャー Openaiは、すべてのChatGPTと加入者の深い研究を解き放ち、研究効率の大幅な後押しを約束しています。 Gemini、Grok 3、Perplexityなどの競合他社から同様の機能をテストした後、Openaiの深い研究を優れた選...AI 2025-04-16に投稿されました

詳細な調査は完全にオープンで、ChatGptとユーザーの利点がありますOpenaiの深い研究:AI研究のためのゲームチェンジャー Openaiは、すべてのChatGPTと加入者の深い研究を解き放ち、研究効率の大幅な後押しを約束しています。 Gemini、Grok 3、Perplexityなどの競合他社から同様の機能をテストした後、Openaiの深い研究を優れた選...AI 2025-04-16に投稿されました -

Amazon Nova Today Real Experience and Review -AnalyticsVidhyaAmazonがNovaを発表する:強化されたAIおよびコンテンツ作成のための最先端の基礎モデル Amazonの最近のRe:Invent 2024イベントは、AIとコンテンツの作成に革命をもたらすように設計された、最も高度な基礎モデルのスイートであるNovaを紹介しました。この記事では、Novaの...AI 2025-04-16に投稿されました

Amazon Nova Today Real Experience and Review -AnalyticsVidhyaAmazonがNovaを発表する:強化されたAIおよびコンテンツ作成のための最先端の基礎モデル Amazonの最近のRe:Invent 2024イベントは、AIとコンテンツの作成に革命をもたらすように設計された、最も高度な基礎モデルのスイートであるNovaを紹介しました。この記事では、Novaの...AI 2025-04-16に投稿されました -

ChatGPTタイミングタスク関数を使用する5つの方法ChatGptの新しいスケジュールされたタスク:ai で一日を自動化する ChatGptは最近、ゲームを変える機能:スケジュールされたタスクを導入しました。 これにより、ユーザーはオフライン中であっても、所定の時期に通知または応答を受信して、繰り返しプロンプトを自動化できます。毎日のキュレ...AI 2025-04-16に投稿されました

ChatGPTタイミングタスク関数を使用する5つの方法ChatGptの新しいスケジュールされたタスク:ai で一日を自動化する ChatGptは最近、ゲームを変える機能:スケジュールされたタスクを導入しました。 これにより、ユーザーはオフライン中であっても、所定の時期に通知または応答を受信して、繰り返しプロンプトを自動化できます。毎日のキュレ...AI 2025-04-16に投稿されました -

3つのAIチャットボットのうち、同じプロンプトに応答するのはどれですか?Claude、ChatGpt、Geminiなどのオプションを使用して、チャットボットを選択すると圧倒的に感じることができます。ノイズを切り抜けるために、同一のプロンプトを使用して3つすべてをテストに入れて、どちらが最良の応答を提供するかを確認します。すべてのツールと同様に、出力はそれを使用す...AI 2025-04-15に投稿されました

3つのAIチャットボットのうち、同じプロンプトに応答するのはどれですか?Claude、ChatGpt、Geminiなどのオプションを使用して、チャットボットを選択すると圧倒的に感じることができます。ノイズを切り抜けるために、同一のプロンプトを使用して3つすべてをテストに入れて、どちらが最良の応答を提供するかを確認します。すべてのツールと同様に、出力はそれを使用す...AI 2025-04-15に投稿されました -

chatgptで十分で、専用のAIチャットマシンは必要ありません新しいAIチャットボットが毎日起動している世界では、どちらが正しい「1つ」であるかを決定するのは圧倒的です。しかし、私の経験では、CHATGPTは、プラットフォーム間を切り替える必要なく、私が投げたすべてのものを、少し迅速なエンジニアリングで処理します。 スペシャリストAIチャットボットは、多く...AI 2025-04-14に投稿されました

chatgptで十分で、専用のAIチャットマシンは必要ありません新しいAIチャットボットが毎日起動している世界では、どちらが正しい「1つ」であるかを決定するのは圧倒的です。しかし、私の経験では、CHATGPTは、プラットフォーム間を切り替える必要なく、私が投げたすべてのものを、少し迅速なエンジニアリングで処理します。 スペシャリストAIチャットボットは、多く...AI 2025-04-14に投稿されました -

インドのAIの瞬間:生成AIにおける中国と米国との競争インドのAI野心:2025アップデート 中国と米国が生成AIに多額の投資をしているため、インドは独自のGenaiイニシアチブを加速しています。 インドの多様な言語的および文化的景観に対応する先住民族の大手言語モデル(LLMS)とAIツールの緊急の必要性は否定できません。 この記事では、インドの急...AI 2025-04-13に投稿されました

インドのAIの瞬間:生成AIにおける中国と米国との競争インドのAI野心:2025アップデート 中国と米国が生成AIに多額の投資をしているため、インドは独自のGenaiイニシアチブを加速しています。 インドの多様な言語的および文化的景観に対応する先住民族の大手言語モデル(LLMS)とAIツールの緊急の必要性は否定できません。 この記事では、インドの急...AI 2025-04-13に投稿されました -

気流とDockerを使用してCSVのインポートをPostgreSQLに自動化するこのチュートリアルは、Apache Airflow、Docker、およびPostgreSQLを使用して堅牢なデータパイプラインを構築して、CSVファイルからデータベースへのデータ転送を自動化することを示しています。 効率的なワークフロー管理のために、DAG、タスク、演算子などのコアエアフローの概念...AI 2025-04-12に投稿されました

気流とDockerを使用してCSVのインポートをPostgreSQLに自動化するこのチュートリアルは、Apache Airflow、Docker、およびPostgreSQLを使用して堅牢なデータパイプラインを構築して、CSVファイルからデータベースへのデータ転送を自動化することを示しています。 効率的なワークフロー管理のために、DAG、タスク、演算子などのコアエアフローの概念...AI 2025-04-12に投稿されました

中国語を勉強する

- 1 「歩く」は中国語で何と言いますか? 走路 中国語の発音、走路 中国語学習

- 2 「飛行機に乗る」は中国語で何と言いますか? 坐飞机 中国語の発音、坐飞机 中国語学習

- 3 「電車に乗る」は中国語で何と言いますか? 坐火车 中国語の発音、坐火车 中国語学習

- 4 「バスに乗る」は中国語で何と言いますか? 坐车 中国語の発音、坐车 中国語学習

- 5 中国語でドライブは何と言うでしょう? 开车 中国語の発音、开车 中国語学習

- 6 水泳は中国語で何と言うでしょう? 游泳 中国語の発音、游泳 中国語学習

- 7 中国語で自転車に乗るってなんて言うの? 骑自行车 中国語の発音、骑自行车 中国語学習

- 8 中国語で挨拶はなんて言うの? 你好中国語の発音、你好中国語学習

- 9 中国語でありがとうってなんて言うの? 谢谢中国語の発音、谢谢中国語学習

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning