ROBOFLOW - treine e teste com python

Roboflow é uma plataforma para anotação de imagens para uso em IA de detecção de objetos.

Eu uso esta plataforma para C2SMR c2smr.fr, minha associação de visão computacional para resgate marítimo.

Neste artigo mostro como usar esta plataforma e treinar seu modelo com python.

Você pode encontrar mais exemplos de código em meu github: https://github.com/C2SMR/detector

I - Conjunto de dados

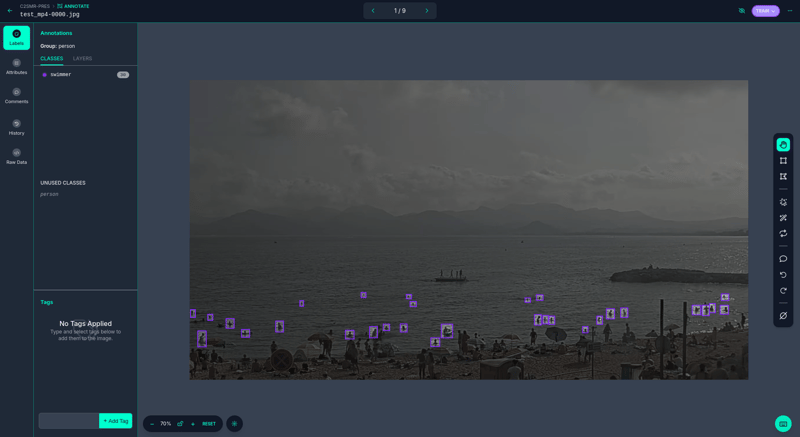

Para criar seu conjunto de dados, acesse https://app.roboflow.com/ e comece a anotar sua imagem conforme mostrado na imagem a seguir.

Neste exemplo, desvio todos os nadadores para prever sua posição em imagens futuras.

Para obter um bom resultado, corte todos os nadadores e coloque a caixa delimitadora logo após o objeto para cercá-lo corretamente.

Você já pode usar um conjunto de dados roboflow público, para isso verifique https://universe.roboflow.com/

II - Treinamento

Para a etapa de treinamento, você pode usar o roboflow diretamente, mas na terceira vez você terá que pagar, por isso estou mostrando como fazer isso com seu laptop.

A primeira etapa é importar seu conjunto de dados. Para fazer isso, você pode importar a biblioteca Roboflow.

pip install roboflow

Para criar um modelo, você precisa usar o algoritmo YOLO, que pode ser importado com a biblioteca ultralítica.

pip install ultralytics

No meu script, eu uso o seguinte comando:

py train.py api-key project-workspace project-name project-version nb-epoch size_model

Você deve obter:

- a chave de acesso

- espaço de trabalho

- nome do projeto roboflow

- versão do conjunto de dados do projeto

- número de épocas para treinar o modelo

- tamanho da rede neural

Inicialmente, o script baixa yolov8-obb.pt, o peso padrão do yolo com dados pré-treino, para facilitar o treinamento.

import sys

import os

import random

from roboflow import Roboflow

from ultralytics import YOLO

import yaml

import time

class Main:

rf: Roboflow

project: object

dataset: object

model: object

results: object

model_size: str

def __init__(self):

self.model_size = sys.argv[6]

self.import_dataset()

self.train()

def import_dataset(self):

self.rf = Roboflow(api_key=sys.argv[1])

self.project = self.rf.workspace(sys.argv[2]).project(sys.argv[3])

self.dataset = self.project.version(sys.argv[4]).download("yolov8-obb")

with open(f'{self.dataset.location}/data.yaml', 'r') as file:

data = yaml.safe_load(file)

data['path'] = self.dataset.location

with open(f'{self.dataset.location}/data.yaml', 'w') as file:

yaml.dump(data, file, sort_keys=False)

def train(self):

list_of_models = ["n", "s", "m", "l", "x"]

if self.model_size != "ALL" and self.model_size in list_of_models:

self.model = YOLO(f"yolov8{self.model_size}-obb.pt")

self.results = self.model.train(data=f"{self.dataset.location}/"

f"yolov8-obb.yaml",

epochs=int(sys.argv[5]), imgsz=640)

elif self.model_size == "ALL":

for model_size in list_of_models:

self.model = YOLO(f"yolov8{model_size}.pt")

self.results = self.model.train(data=f"{self.dataset.location}"

f"/yolov8-obb.yaml",

epochs=int(sys.argv[5]),

imgsz=640)

else:

print("Invalid model size")

if __name__ == '__main__':

Main()

III - Exibição

Após treinar o modelo, você obtém os arquivos best.py e last.py, que correspondem ao peso.

Com a biblioteca ultralítica, você também pode importar YOLO e carregar seu peso e depois seu vídeo de teste.

Neste exemplo, estou usando a função de rastreamento para obter um ID para cada nadador.

import cv2

from ultralytics import YOLO

import sys

def main():

cap = cv2.VideoCapture(sys.argv[1])

model = YOLO(sys.argv[2])

while True:

ret, frame = cap.read()

results = model.track(frame, persist=True)

res_plotted = results[0].plot()

cv2.imshow("frame", res_plotted)

if cv2.waitKey(1) == 27:

break

cap.release()

cv2.destroyAllWindows()

if __name__ == "__main__":

main()

Para analisar a previsão, você pode obter o modelo json da seguinte maneira.

results = model.track(frame, persist=True) results_json = json.loads(results[0].tojson())

-

Compreendendo o JavaScript assíncronoJavaScript é uma linguagem de thread único, o que significa que só pode fazer uma coisa por vez. No entanto, os aplicativos da web geralmente precisam...Programação Publicado em 2024-11-07

Compreendendo o JavaScript assíncronoJavaScript é uma linguagem de thread único, o que significa que só pode fazer uma coisa por vez. No entanto, os aplicativos da web geralmente precisam...Programação Publicado em 2024-11-07 -

Erros que você deve evitar (e como corrigi-los)Como desenvolvedor React, é fácil cair em certos padrões de codificação que podem parecer convenientes no início, mas que podem levar a problemas no f...Programação Publicado em 2024-11-07

Erros que você deve evitar (e como corrigi-los)Como desenvolvedor React, é fácil cair em certos padrões de codificação que podem parecer convenientes no início, mas que podem levar a problemas no f...Programação Publicado em 2024-11-07 -

Como posso acessar valores de variáveis JavaScript em PHP?Usando valores de variáveis JavaScript em PHPAo trabalhar com aplicações web que envolvem JavaScript e PHP, muitas vezes é necessário trocar dados e...Programação Publicado em 2024-11-07

Como posso acessar valores de variáveis JavaScript em PHP?Usando valores de variáveis JavaScript em PHPAo trabalhar com aplicações web que envolvem JavaScript e PHP, muitas vezes é necessário trocar dados e...Programação Publicado em 2024-11-07 -

Caixa de diálogo Popver API VS Modal: igual, mas diferenteEu estava lendo alguns blogs de notícias de tecnologia e me deparei com o título Popover API chega ao Baseline. Fiquei confuso, durante meu recente me...Programação Publicado em 2024-11-07

Caixa de diálogo Popver API VS Modal: igual, mas diferenteEu estava lendo alguns blogs de notícias de tecnologia e me deparei com o título Popover API chega ao Baseline. Fiquei confuso, durante meu recente me...Programação Publicado em 2024-11-07 -

Você pode obter herança de método sem incorporar estruturas?Estruturas incorporadas: uma exploração da herança de métodosCompreendendo a herança de métodos em GoIn Go, a capacidade de herdar métodos de um tipo ...Programação Publicado em 2024-11-07

Você pode obter herança de método sem incorporar estruturas?Estruturas incorporadas: uma exploração da herança de métodosCompreendendo a herança de métodos em GoIn Go, a capacidade de herdar métodos de um tipo ...Programação Publicado em 2024-11-07 -

Como recuperar chaves de array dentro de um loop Foreach em PHPRecuperar chaves de array durante o loop Foreach: PHPAo trabalhar com arrays em PHP, muitas vezes é necessário recuperar as chaves e os valores dentro...Programação Publicado em 2024-11-07

Como recuperar chaves de array dentro de um loop Foreach em PHPRecuperar chaves de array durante o loop Foreach: PHPAo trabalhar com arrays em PHP, muitas vezes é necessário recuperar as chaves e os valores dentro...Programação Publicado em 2024-11-07 -

Métodos para criar objetos em JavaScriptIntrodução Existem algumas maneiras de criar um objeto em JavaScript. Literais de objeto Construtor Object() Object.create() Função construto...Programação Publicado em 2024-11-07

Métodos para criar objetos em JavaScriptIntrodução Existem algumas maneiras de criar um objeto em JavaScript. Literais de objeto Construtor Object() Object.create() Função construto...Programação Publicado em 2024-11-07 -

Como estender objetos de erro para exceções personalizadas em JavaScript?Estendendo objetos de erro em JavaScriptAo lançar exceções em JavaScript, pode-se desejar estender o objeto Error integrado para criar erros personali...Programação Publicado em 2024-11-07

Como estender objetos de erro para exceções personalizadas em JavaScript?Estendendo objetos de erro em JavaScriptAo lançar exceções em JavaScript, pode-se desejar estender o objeto Error integrado para criar erros personali...Programação Publicado em 2024-11-07 -

Como o MySQL garante a integridade dos dados em operações simultâneas?Simultaneidade MySQL: garantindo a integridade dos dadosSe seu banco de dados MySQL estiver usando o mecanismo de armazenamento InnoDB, você pode esta...Programação Publicado em 2024-11-07

Como o MySQL garante a integridade dos dados em operações simultâneas?Simultaneidade MySQL: garantindo a integridade dos dadosSe seu banco de dados MySQL estiver usando o mecanismo de armazenamento InnoDB, você pode esta...Programação Publicado em 2024-11-07 -

Como concatenar strings com valores de maneira eficaz em consultas SQL usando Go?Criando consultas SQL de maneira eficaz no GoConcatenar strings com valores em consultas SQL de texto pode ser um pouco complicado no Go. Ao contrário...Programação Publicado em 2024-11-07

Como concatenar strings com valores de maneira eficaz em consultas SQL usando Go?Criando consultas SQL de maneira eficaz no GoConcatenar strings com valores em consultas SQL de texto pode ser um pouco complicado no Go. Ao contrário...Programação Publicado em 2024-11-07 -

Por que json_encode() falha ao codificar caracteres acentuados de um banco de dados MySQL com codificação Latin1?A codificação JSON tem dificuldades com caracteres UTF-8 no MySQLAo tentar recuperar caracteres acentuados de um banco de dados com codificação latin1...Programação Publicado em 2024-11-07

Por que json_encode() falha ao codificar caracteres acentuados de um banco de dados MySQL com codificação Latin1?A codificação JSON tem dificuldades com caracteres UTF-8 no MySQLAo tentar recuperar caracteres acentuados de um banco de dados com codificação latin1...Programação Publicado em 2024-11-07 -

Como transpor linhas em colunas no MySQL: um guia abrangenteTransposição de linhas em colunas no MySQLA conversão de linhas em colunas em uma consulta MySQL requer consultas complexas ou manipulação manual em u...Programação Publicado em 2024-11-07

Como transpor linhas em colunas no MySQL: um guia abrangenteTransposição de linhas em colunas no MySQLA conversão de linhas em colunas em uma consulta MySQL requer consultas complexas ou manipulação manual em u...Programação Publicado em 2024-11-07 -

Como resolver notificações do GCM não recebidas em modo de segundo plano no iOSNotificações do GCM não recebidas quando o aplicativo está no modo de segundo plano no iOSEsse problema surge quando o iOS recebe notificações em segu...Programação Publicado em 2024-11-07

Como resolver notificações do GCM não recebidas em modo de segundo plano no iOSNotificações do GCM não recebidas quando o aplicativo está no modo de segundo plano no iOSEsse problema surge quando o iOS recebe notificações em segu...Programação Publicado em 2024-11-07 -

Por que estou recebendo uma ClassNotFoundException ao usar CLASSPATH no Windows 7?Resolvendo java.lang.ClassNotFoundException apesar de usar a variável de ambiente CLASSPATHAo tentar se conectar a um banco de dados MySQL usando Java...Programação Publicado em 2024-11-07

Por que estou recebendo uma ClassNotFoundException ao usar CLASSPATH no Windows 7?Resolvendo java.lang.ClassNotFoundException apesar de usar a variável de ambiente CLASSPATHAo tentar se conectar a um banco de dados MySQL usando Java...Programação Publicado em 2024-11-07 -

Os desenvolvedores precisam saber sobre a API Forex gratuitaSe você é desenvolvedor, deve estar em busca de ferramentas que ajudem a facilitar seu trabalho, certo? Uma API forex gratuita é uma dessas ferrament...Programação Publicado em 2024-11-07

Os desenvolvedores precisam saber sobre a API Forex gratuitaSe você é desenvolvedor, deve estar em busca de ferramentas que ajudem a facilitar seu trabalho, certo? Uma API forex gratuita é uma dessas ferrament...Programação Publicado em 2024-11-07

Estude chinês

- 1 Como se diz “andar” em chinês? 走路 Pronúncia chinesa, 走路 aprendizagem chinesa

- 2 Como se diz “pegar um avião” em chinês? 坐飞机 Pronúncia chinesa, 坐飞机 aprendizagem chinesa

- 3 Como se diz “pegar um trem” em chinês? 坐火车 Pronúncia chinesa, 坐火车 aprendizagem chinesa

- 4 Como se diz “pegar um ônibus” em chinês? 坐车 Pronúncia chinesa, 坐车 aprendizagem chinesa

- 5 Como se diz dirigir em chinês? 开车 Pronúncia chinesa, 开车 aprendizagem chinesa

- 6 Como se diz nadar em chinês? 游泳 Pronúncia chinesa, 游泳 aprendizagem chinesa

- 7 Como se diz andar de bicicleta em chinês? 骑自行车 Pronúncia chinesa, 骑自行车 aprendizagem chinesa

- 8 Como você diz olá em chinês? 你好Pronúncia chinesa, 你好Aprendizagem chinesa

- 9 Como você agradece em chinês? 谢谢Pronúncia chinesa, 谢谢Aprendizagem chinesa

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning