Primeira página > IA > Além dos LLMs: Veja por que os modelos de linguagem pequena são o futuro da IA

Primeira página > IA > Além dos LLMs: Veja por que os modelos de linguagem pequena são o futuro da IA

Além dos LLMs: Veja por que os modelos de linguagem pequena são o futuro da IA

Grandes modelos de linguagem (LLMs) entraram em cena com o lançamento do ChatGPT da Open AI. Desde então, várias empresas também lançaram seus LLMs, mas agora mais empresas estão se inclinando para modelos de linguagem pequena (SLMs).

SLMs estão ganhando impulso, mas o que são e como diferem dos LLMs?

O que é um modelo de linguagem pequena?

Um modelo de linguagem pequena (SLM) é um tipo de modelo de inteligência artificial com menos parâmetros (pense nisso como um valor no modelo aprendido durante o treinamento). Tal como os seus homólogos maiores, os SLMs podem gerar texto e realizar outras tarefas. No entanto, os SLMs usam menos conjuntos de dados para treinamento, têm menos parâmetros e exigem menos poder computacional para treinar e executar.

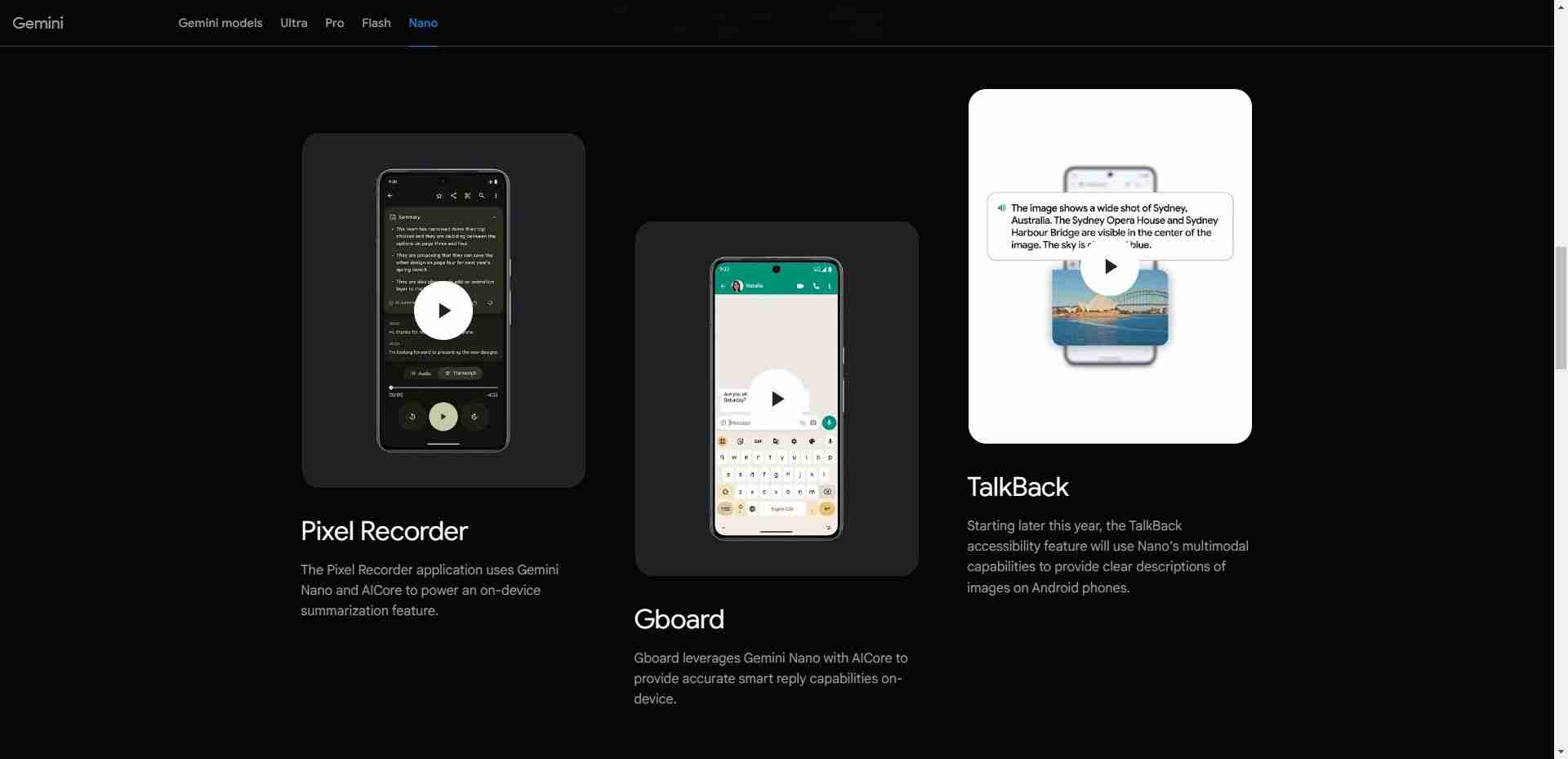

Os SLMs se concentram nas principais funcionalidades e seu pequeno espaço ocupado significa que podem ser implantados em diferentes dispositivos, incluindo aqueles que não possuem hardware de última geração, como dispositivos móveis. Por exemplo, o Nano do Google é um SLM no dispositivo desenvolvido desde o início e executado em dispositivos móveis. Devido ao seu pequeno tamanho, o Nano pode ser executado localmente com ou sem conectividade de rede, de acordo com a empresa.

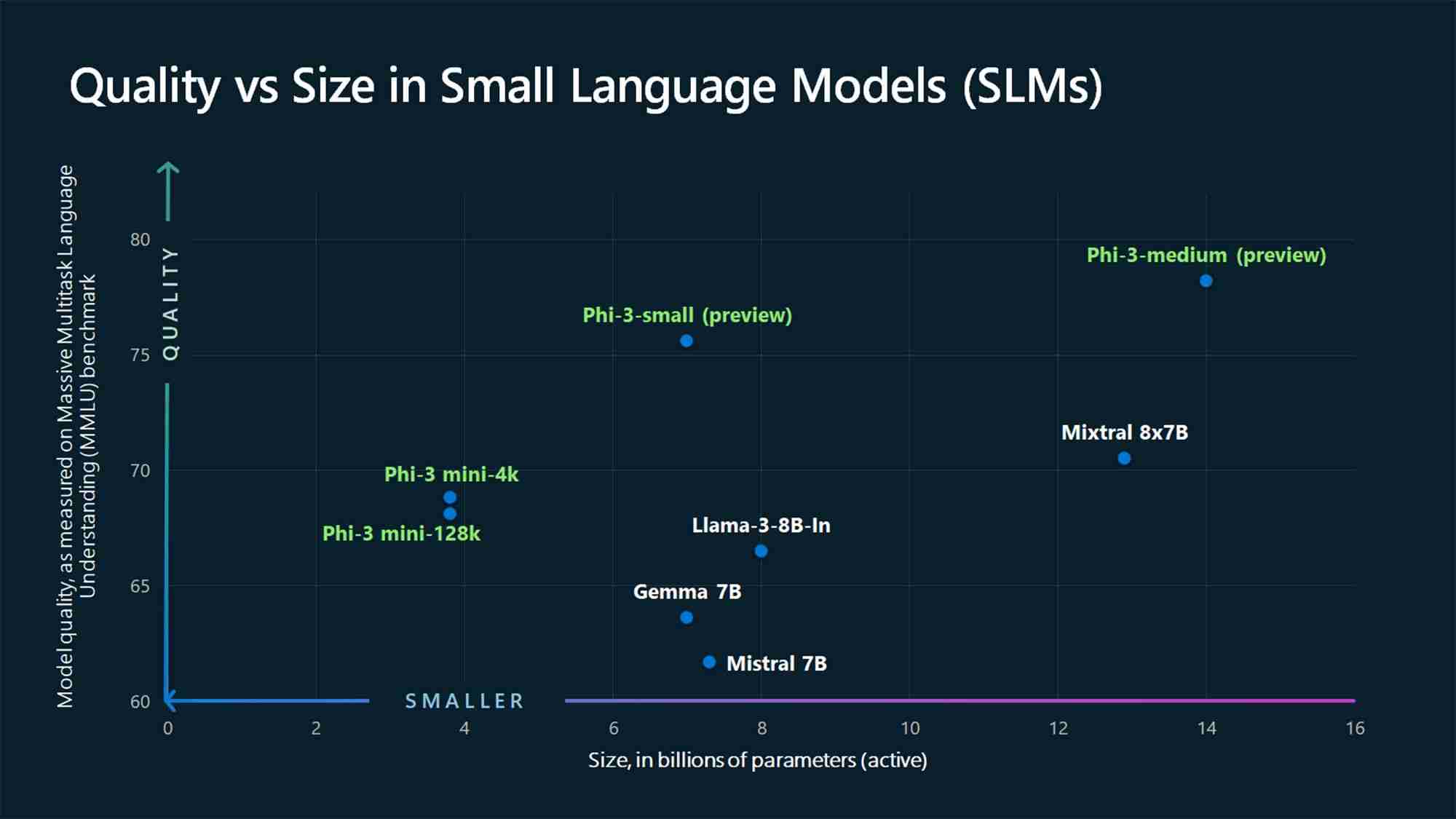

Além do Nano, existem muitos outros SLMs de empresas líderes e futuras no espaço de IA. Alguns SLMs populares incluem Phi-3 da Microsoft, GPT-4o mini da OpenAI, Claude 3 Haiku da Anthropic, Llama 3 da Meta e Mixtral 8x7B da Mistral AI. SLMs. Isto é especialmente verdadeiro considerando que a maioria das empresas está adotando a abordagem multimodelo de lançar mais de um modelo de linguagem em seu portfólio, oferecendo LLMs e SLMs. Um exemplo é o GPT-4, que possui vários modelos, incluindo GPT-4, GPT-4o (Omni) e GPT-4o mini.

Modelos de linguagem pequena versus modelos de linguagem grande

Ao discutir SLMs, não podemos ignorar seus grandes equivalentes: LLMs. A principal diferença entre um SLM e um LLM é o tamanho do modelo, que é medido em termos de parâmetros.

No momento em que este livro foi escrito, não havia consenso na indústria de IA sobre o número máximo de parâmetros que um modelo não deveria exceder para ser considerado um SLM ou o número mínimo necessário para ser considerado um LLM. No entanto, os SLMs normalmente têm de milhões a alguns bilhões de parâmetros, enquanto os LLMs têm mais, chegando a trilhões.

Por exemplo, o GPT-3, que foi lançado em 2020, tem 175 bilhões de parâmetros (e o Há rumores de que o modelo GPT-4 tem cerca de 1,76 trilhão), enquanto os SLMs 2024 Phi-3-mini, Phi-3-small e Phi-3-medium da Microsoft medem 3,8, 7 e 14 bilhões de parâmetros, respectivamente.

Outro fator de diferenciação entre SLMs e LLMs é a quantidade de dados usados para treinamento. Os SLMs são treinados em quantidades menores de dados, enquanto os LLMs usam grandes conjuntos de dados. Essa diferença também afeta a capacidade do modelo de resolver tarefas complexas.

Devido ao grande volume de dados usados no treinamento, os LLMs são mais adequados para resolver diferentes tipos de tarefas complexas que exigem raciocínio avançado, enquanto os SLMs são mais adequados para tarefas mais simples. tarefas. Ao contrário dos LLMs, os SLMs usam menos dados de treinamento, mas os dados usados devem ser de maior qualidade para alcançar muitos dos recursos encontrados nos LLMs em um pacote minúsculo. Por que modelos de linguagem pequena são o futuro Para a maioria dos casos de uso, os SLMs estão melhor posicionados para se tornarem os modelos convencionais usados por empresas e consumidores para executar uma ampla variedade de tarefas. Claro, os LLMs têm suas vantagens e são mais adequados para determinados casos de uso, como a resolução de tarefas complexas. No entanto, SLMs são o futuro para a maioria dos casos de uso devido aos seguintes motivos.

Devido ao grande volume de dados usados no treinamento, os LLMs são mais adequados para resolver diferentes tipos de tarefas complexas que exigem raciocínio avançado, enquanto os SLMs são mais adequados para tarefas mais simples. tarefas. Ao contrário dos LLMs, os SLMs usam menos dados de treinamento, mas os dados usados devem ser de maior qualidade para alcançar muitos dos recursos encontrados nos LLMs em um pacote minúsculo. Por que modelos de linguagem pequena são o futuro Para a maioria dos casos de uso, os SLMs estão melhor posicionados para se tornarem os modelos convencionais usados por empresas e consumidores para executar uma ampla variedade de tarefas. Claro, os LLMs têm suas vantagens e são mais adequados para determinados casos de uso, como a resolução de tarefas complexas. No entanto, SLMs são o futuro para a maioria dos casos de uso devido aos seguintes motivos.1. Menor custo de treinamento e manutenção

SLMs precisam de menos dados para treinamento do que LLMs, o que os torna a opção mais viável para indivíduos e pequenas e médias empresas com dados de treinamento, finanças ou ambos limitados. LLMs exigem grandes quantidades de dados de treinamento e, por extensão, precisam de enormes recursos computacionais para treinar e funcionar.

Para colocar isso em perspectiva, o CEO da OpenAI, Sam Altman, confirmou que foram necessários mais de US$ 100 milhões para treinar GPT-4 enquanto discursava em um evento no MIT (conforme Wired). Outro exemplo é o OPT-175B LLM da Meta. Meta diz que foi treinado usando 992 GPUs NVIDIA A100 de 80 GB, que custam cerca de US$ 10.000 por unidade, conforme CNBC. Isso coloca o custo em aproximadamente US$ 9 milhões, sem incluir outras despesas como energia, salários e muito mais.

Para colocar isso em perspectiva, o CEO da OpenAI, Sam Altman, confirmou que foram necessários mais de US$ 100 milhões para treinar GPT-4 enquanto discursava em um evento no MIT (conforme Wired). Outro exemplo é o OPT-175B LLM da Meta. Meta diz que foi treinado usando 992 GPUs NVIDIA A100 de 80 GB, que custam cerca de US$ 10.000 por unidade, conforme CNBC. Isso coloca o custo em aproximadamente US$ 9 milhões, sem incluir outras despesas como energia, salários e muito mais.Com esses números, não é viável para pequenas e médias empresas treinar um LLM. Em contraste, os SLMs têm uma barreira de entrada menor em termos de recursos e custam menos para serem administrados e, portanto, mais empresas irão adotá-los. 2. Melhor desempenho

Desempenho é outro área onde os SLMs vencem os LLMs devido ao seu tamanho compacto. Os SLMs têm menos latência e são mais adequados para cenários onde são necessárias respostas mais rápidas, como em aplicações em tempo real. Por exemplo, uma resposta mais rápida é preferida em sistemas de resposta de voz, como assistentes digitais.

Executar no dispositivo (mais sobre isso mais tarde) também significa que sua solicitação não precisa ir até servidores on-line e voltar para responda à sua consulta, levando a respostas mais rápidas.

Executar no dispositivo (mais sobre isso mais tarde) também significa que sua solicitação não precisa ir até servidores on-line e voltar para responda à sua consulta, levando a respostas mais rápidas.3. Mais preciso

Quando se trata de IA generativa, uma coisa permanece constante: lixo entra, lixo sai. Os LLMs atuais foram treinados usando grandes conjuntos de dados brutos da Internet. Portanto, eles podem não ser precisos em todas as situações. Este é um dos problemas do ChatGPT e modelos semelhantes e é por isso que você não deve confiar em tudo o que um chatbot de IA diz. Por outro lado, os SLMs são treinados usando dados de maior qualidade do que os LLMs e, portanto, têm maior precisão.

SLMs também podem ser ajustados ainda mais com treinamento focado em tarefas ou domínios específicos, levando a uma melhor precisão naqueles. áreas em comparação com modelos maiores e mais generalizados.

SLMs também podem ser ajustados ainda mais com treinamento focado em tarefas ou domínios específicos, levando a uma melhor precisão naqueles. áreas em comparação com modelos maiores e mais generalizados.4. Podem ser executados no dispositivo

SLMs precisam de menos poder computacional do que LLMs e, portanto, são ideais para casos de computação de ponta. Eles podem ser implantados em dispositivos de ponta, como smartphones e veículos autônomos, que não possuem grande poder ou recursos computacionais. O modelo Nano do Google pode ser executado no dispositivo, permitindo que funcione mesmo quando você não tem uma conexão ativa com a Internet.

Essa capacidade apresenta uma situação vantajosa para empresas e consumidores. Em primeiro lugar, é uma vitória para a privacidade, uma vez que os dados dos utilizadores são processados localmente em vez de enviados para a nuvem, o que é importante à medida que mais IA é integrada nos nossos smartphones, contendo quase todos os detalhes sobre nós. Também é uma vitória para as empresas, pois elas não precisam implantar e executar grandes servidores para lidar com tarefas de IA.

Essa capacidade apresenta uma situação vantajosa para empresas e consumidores. Em primeiro lugar, é uma vitória para a privacidade, uma vez que os dados dos utilizadores são processados localmente em vez de enviados para a nuvem, o que é importante à medida que mais IA é integrada nos nossos smartphones, contendo quase todos os detalhes sobre nós. Também é uma vitória para as empresas, pois elas não precisam implantar e executar grandes servidores para lidar com tarefas de IA.Os SLMs estão ganhando impulso, com os maiores participantes do setor, como Open AI, Google, Microsoft, Antrópico e Meta, lançando tais modelos. Esses modelos são mais adequados para tarefas mais simples, para as quais a maioria de nós usa LLMs; portanto, eles são o futuro.Mas os LLMs não vão a lugar nenhum. Em vez disso, serão utilizados para aplicações avançadas que combinam informações de diferentes domínios para criar algo novo, como na investigação médica.

-

Algoritmos de inteligência de enxames: três implementações do PythonImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...IA Postado em 2025-03-24

Algoritmos de inteligência de enxames: três implementações do PythonImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...IA Postado em 2025-03-24 -

Como tornar seu LLM mais preciso com pano e ajuste finoImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...IA Postado em 2025-03-24

Como tornar seu LLM mais preciso com pano e ajuste finoImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...IA Postado em 2025-03-24 -

O que é o Google Gemini? Tudo o que você precisa saber sobre o rival ChatGPT do GoogleGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...IA Postado em 2025-03-23

O que é o Google Gemini? Tudo o que você precisa saber sobre o rival ChatGPT do GoogleGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...IA Postado em 2025-03-23 -

Guia sobre solicitação com DSPYdspy: uma estrutura declarativa para a construção e melhoria de aplicativos LLM DSPY (programas de idiomas auto-improvantes declarativos) revolucio...IA Postado em 2025-03-22

Guia sobre solicitação com DSPYdspy: uma estrutura declarativa para a construção e melhoria de aplicativos LLM DSPY (programas de idiomas auto-improvantes declarativos) revolucio...IA Postado em 2025-03-22 -

Automatize o blog para o tópico do TwitterEste artigo detalha automatização da conversão de conteúdo de formato longo (como postagens de blog) em tópicos envolventes no Twitter usando o gemin...IA Postado em 2025-03-11

Automatize o blog para o tópico do TwitterEste artigo detalha automatização da conversão de conteúdo de formato longo (como postagens de blog) em tópicos envolventes no Twitter usando o gemin...IA Postado em 2025-03-11 -

Sistema imunológico artificial (AIS): um guia com exemplos de pythonEste artigo explora sistemas imunológicos artificiais (AIS), modelos computacionais inspirados na notável capacidade do sistema imunológico humano de...IA Postado em 2025-03-04

Sistema imunológico artificial (AIS): um guia com exemplos de pythonEste artigo explora sistemas imunológicos artificiais (AIS), modelos computacionais inspirados na notável capacidade do sistema imunológico humano de...IA Postado em 2025-03-04 -

Tente fazer ao ChatGPT estas perguntas divertidas sobre vocêJá se perguntou o que o ChatGPT sabe sobre você? Como ele processa as informações que você forneceu ao longo do tempo? Eu usei montes de ChatGPT em di...IA Publicado em 2024-11-22

Tente fazer ao ChatGPT estas perguntas divertidas sobre vocêJá se perguntou o que o ChatGPT sabe sobre você? Como ele processa as informações que você forneceu ao longo do tempo? Eu usei montes de ChatGPT em di...IA Publicado em 2024-11-22 -

Veja como você ainda pode experimentar o misterioso chatbot GPT-2Se você gosta de modelos de IA ou chatbots, talvez já tenha visto discussões sobre o misterioso chatbot GPT-2 e sua eficácia.Aqui, explicamos o que é ...IA Publicado em 2024-11-08

Veja como você ainda pode experimentar o misterioso chatbot GPT-2Se você gosta de modelos de IA ou chatbots, talvez já tenha visto discussões sobre o misterioso chatbot GPT-2 e sua eficácia.Aqui, explicamos o que é ...IA Publicado em 2024-11-08 -

O modo Canvas do ChatGPT é ótimo: estas são 4 maneiras de usá-loO novo modo Canvas do ChatGPT adicionou uma dimensão extra à escrita e edição na ferramenta de IA generativa líder mundial. Tenho usado o ChatGPT Canv...IA Publicado em 2024-11-08

O modo Canvas do ChatGPT é ótimo: estas são 4 maneiras de usá-loO novo modo Canvas do ChatGPT adicionou uma dimensão extra à escrita e edição na ferramenta de IA generativa líder mundial. Tenho usado o ChatGPT Canv...IA Publicado em 2024-11-08 -

Como os GPTs personalizados do ChatGPT podem expor seus dados e como mantê-los segurosO recurso GPT personalizado do ChatGPT permite que qualquer pessoa crie uma ferramenta de IA personalizada para quase tudo que você possa imaginar; G...IA Publicado em 2024-11-08

Como os GPTs personalizados do ChatGPT podem expor seus dados e como mantê-los segurosO recurso GPT personalizado do ChatGPT permite que qualquer pessoa crie uma ferramenta de IA personalizada para quase tudo que você possa imaginar; G...IA Publicado em 2024-11-08 -

10 maneiras pelas quais o ChatGPT pode ajudá-lo a conseguir um emprego no LinkedInCom 2.600 caracteres disponíveis, a seção Sobre do seu perfil do LinkedIn é um ótimo espaço para falar sobre sua experiência, habilidades, paixões e ...IA Publicado em 2024-11-08

10 maneiras pelas quais o ChatGPT pode ajudá-lo a conseguir um emprego no LinkedInCom 2.600 caracteres disponíveis, a seção Sobre do seu perfil do LinkedIn é um ótimo espaço para falar sobre sua experiência, habilidades, paixões e ...IA Publicado em 2024-11-08 -

Confira estes 6 aplicativos de IA menos conhecidos que oferecem experiências únicasNeste ponto, a maioria das pessoas já ouviu falar do ChatGPT e do Copilot, dois aplicativos pioneiros de IA generativa que lideraram o boom da IA.Mas ...IA Publicado em 2024-11-08

Confira estes 6 aplicativos de IA menos conhecidos que oferecem experiências únicasNeste ponto, a maioria das pessoas já ouviu falar do ChatGPT e do Copilot, dois aplicativos pioneiros de IA generativa que lideraram o boom da IA.Mas ...IA Publicado em 2024-11-08 -

Estes 7 sinais mostram que já atingimos o pico da IAOnde quer que você olhe on-line, há sites, serviços e aplicativos que proclamam que o uso da IA a torna a melhor opção. Não sei sobre você, mas sua ...IA Publicado em 2024-11-08

Estes 7 sinais mostram que já atingimos o pico da IAOnde quer que você olhe on-line, há sites, serviços e aplicativos que proclamam que o uso da IA a torna a melhor opção. Não sei sobre você, mas sua ...IA Publicado em 2024-11-08 -

4 ferramentas de detecção de ChatGPT de verificação de IA para professores, palestrantes e chefesÀ medida que o ChatGPT avança em poder, fica cada vez mais difícil dizer o que é escrito por um ser humano e o que é gerado por uma IA. Isso torna di...IA Publicado em 2024-11-08

4 ferramentas de detecção de ChatGPT de verificação de IA para professores, palestrantes e chefesÀ medida que o ChatGPT avança em poder, fica cada vez mais difícil dizer o que é escrito por um ser humano e o que é gerado por uma IA. Isso torna di...IA Publicado em 2024-11-08 -

O recurso avançado de voz do ChatGPT está sendo lançado para mais usuáriosSe você sempre quis ter uma conversa completa com o ChatGPT, agora você pode. Isto é, desde que você pague pelo privilégio de usar o ChatGPT. Mais usu...IA Publicado em 2024-11-08

O recurso avançado de voz do ChatGPT está sendo lançado para mais usuáriosSe você sempre quis ter uma conversa completa com o ChatGPT, agora você pode. Isto é, desde que você pague pelo privilégio de usar o ChatGPT. Mais usu...IA Publicado em 2024-11-08

Estude chinês

- 1 Como se diz “andar” em chinês? 走路 Pronúncia chinesa, 走路 aprendizagem chinesa

- 2 Como se diz “pegar um avião” em chinês? 坐飞机 Pronúncia chinesa, 坐飞机 aprendizagem chinesa

- 3 Como se diz “pegar um trem” em chinês? 坐火车 Pronúncia chinesa, 坐火车 aprendizagem chinesa

- 4 Como se diz “pegar um ônibus” em chinês? 坐车 Pronúncia chinesa, 坐车 aprendizagem chinesa

- 5 Como se diz dirigir em chinês? 开车 Pronúncia chinesa, 开车 aprendizagem chinesa

- 6 Como se diz nadar em chinês? 游泳 Pronúncia chinesa, 游泳 aprendizagem chinesa

- 7 Como se diz andar de bicicleta em chinês? 骑自行车 Pronúncia chinesa, 骑自行车 aprendizagem chinesa

- 8 Como você diz olá em chinês? 你好Pronúncia chinesa, 你好Aprendizagem chinesa

- 9 Como você agradece em chinês? 谢谢Pronúncia chinesa, 谢谢Aprendizagem chinesa

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning