FLUX LoRA 트레이닝(이제 GPU에서도 작동) 등을 위한 대규모 일일 개발

2024-11-04에 게시됨

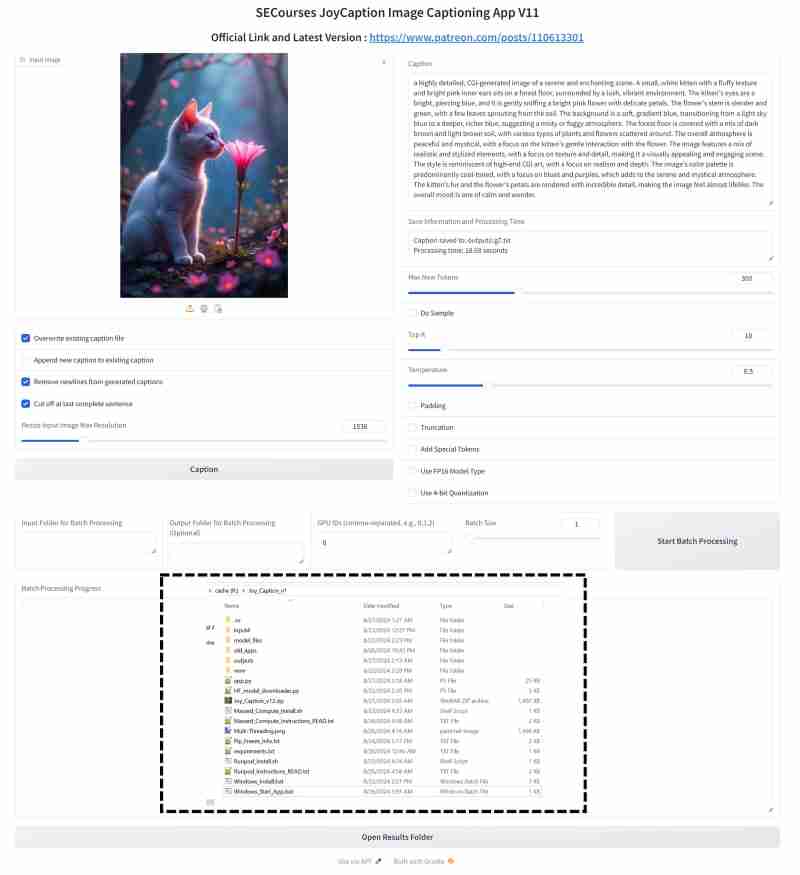

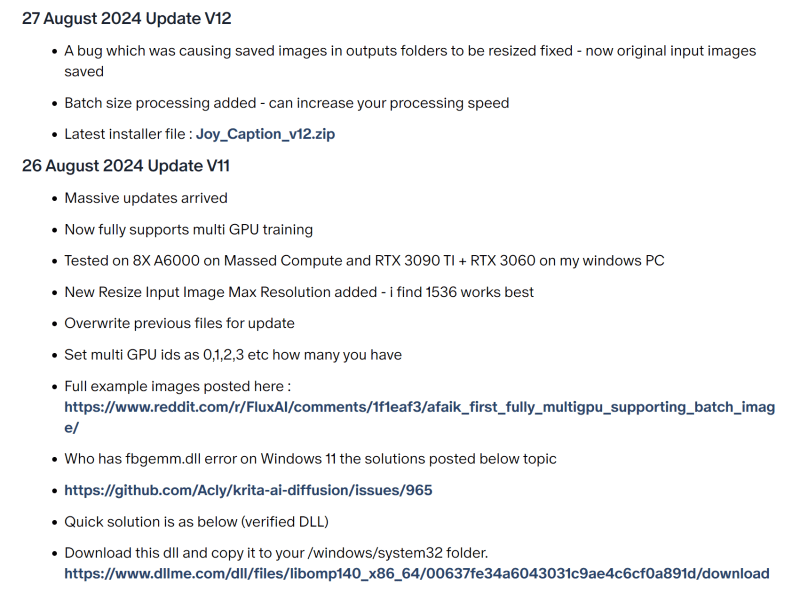

Joycaption은 이제 다중 GPU 지원과 배치 크기 지원을 모두 제공합니다. > https://www.patreon.com/posts/110613301

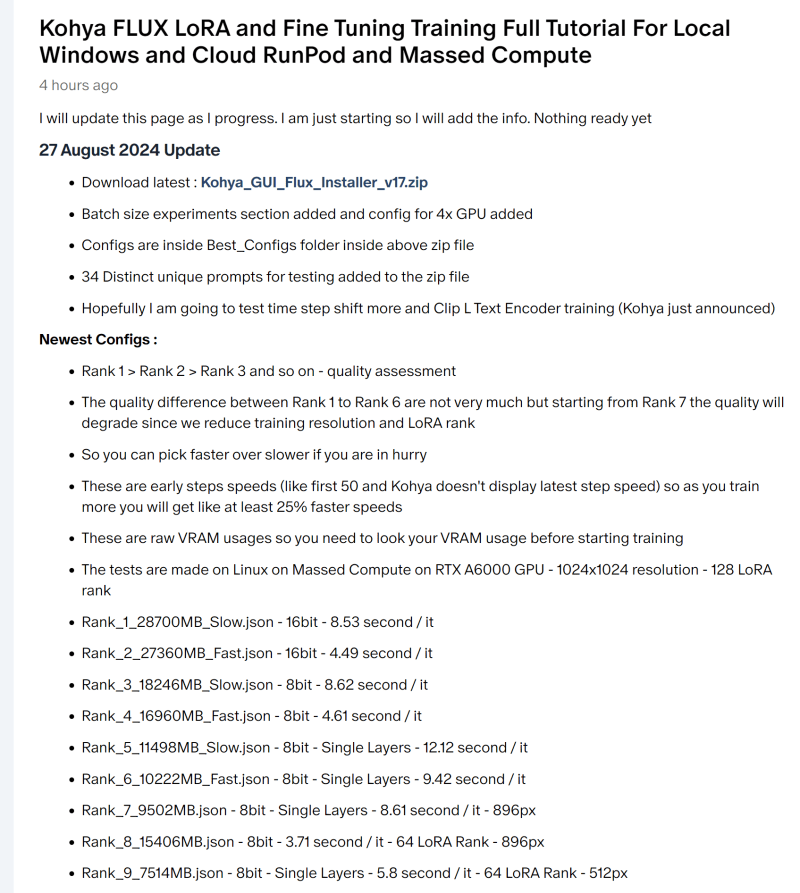

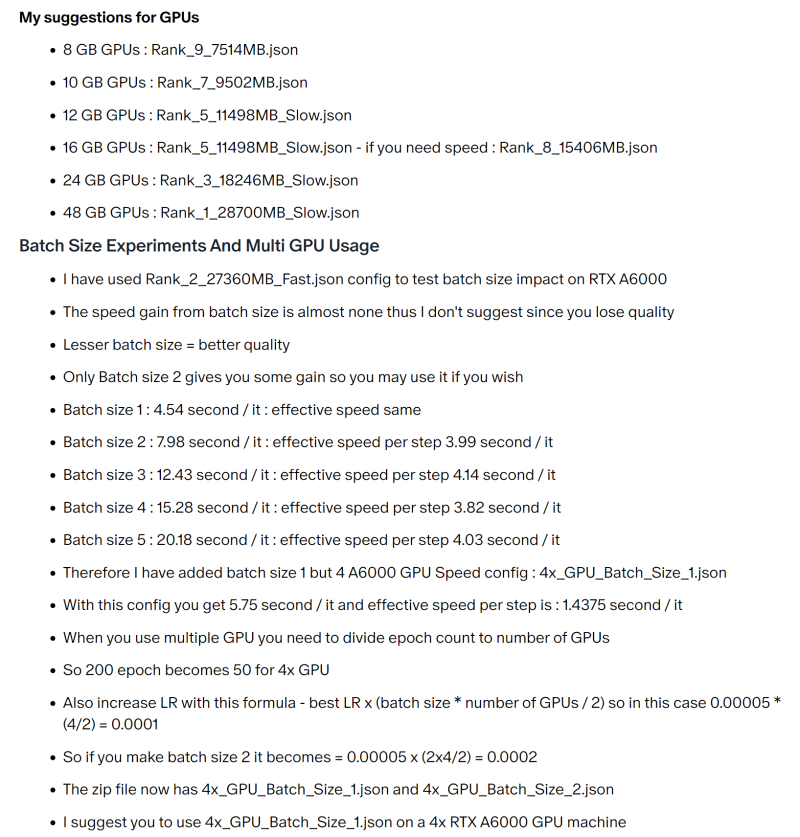

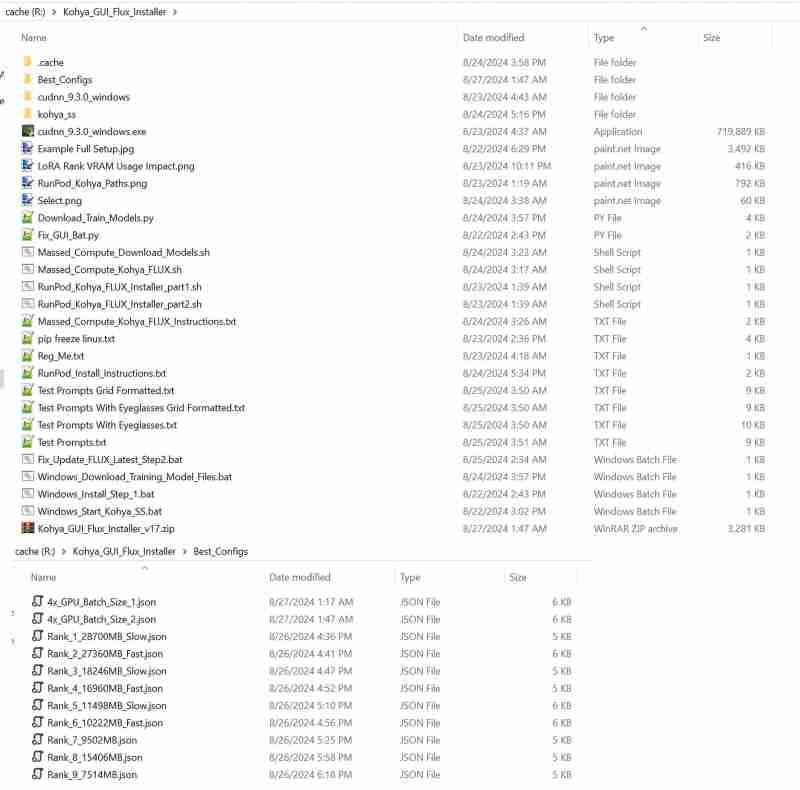

FLUX LoRA 교육 구성이 완전히 업데이트되어 이제 최소 8GB GPU에서도 작동합니다. 예, 8GB GPU에서 120억 개의 매개변수 모델을 교육할 수 있습니다. 매우 우수한 속도와 품질 > https://www.patreon.com /posts/110293257

모든 세부정보를 보려면 이미지를 확인하세요.

릴리스 선언문

이 기사는 https://dev.to/furkangozukara/huge-daily-developments-for-flux-lora-training-now-even-works-on-8gb-gpu-and-more-5802?1에서 재현됩니다. 침해, 삭제를 원하시면 [email protected]으로 연락주시기 바랍니다.

최신 튜토리얼

더>

-

Java Virtual Machine: 라이프사이클 및 클래스 로더JVM(Java Virtual Machine)은 Java 생태계의 핵심으로, Java 코드 실행에 필요한 모든 필수 도구를 제공합니다. 작동 방식을 완전히 이해하려면 이 인터프리터의 수명 주기와 Java 애플리케이션의 성능 및 최적화에 미치는 영향을 이해하는 것이 중요...프로그램 작성 2024년 11월 16일에 게시됨

Java Virtual Machine: 라이프사이클 및 클래스 로더JVM(Java Virtual Machine)은 Java 생태계의 핵심으로, Java 코드 실행에 필요한 모든 필수 도구를 제공합니다. 작동 방식을 완전히 이해하려면 이 인터프리터의 수명 주기와 Java 애플리케이션의 성능 및 최적화에 미치는 영향을 이해하는 것이 중요...프로그램 작성 2024년 11월 16일에 게시됨 -

다음은 JavaScript 정수 확인 기사의 내용과 일치하는 몇 가지 질문 기반 제목입니다. 안정성과 모범 사례에 중점: * Java에서 정수를 안정적으로 확인하는 방법JavaScript에서 정수 변수를 확인하고 정수가 아닌 값에 대해 오류를 발생시키는 방법JavaScript 변수가 정수를 나타내는지 확인하는 것이 중요할 수 있습니다. . 이 검사를 효과적으로 수행하기 위해 여러 접근 방식을 사용할 수 있습니다.옵션 1: isNaN ...프로그램 작성 2024년 11월 16일에 게시됨

다음은 JavaScript 정수 확인 기사의 내용과 일치하는 몇 가지 질문 기반 제목입니다. 안정성과 모범 사례에 중점: * Java에서 정수를 안정적으로 확인하는 방법JavaScript에서 정수 변수를 확인하고 정수가 아닌 값에 대해 오류를 발생시키는 방법JavaScript 변수가 정수를 나타내는지 확인하는 것이 중요할 수 있습니다. . 이 검사를 효과적으로 수행하기 위해 여러 접근 방식을 사용할 수 있습니다.옵션 1: isNaN ...프로그램 작성 2024년 11월 16일에 게시됨 -

멋진 CodePen 데모(10월 4일)경량 물 왜곡 효과 Ksenia Kondrashova는 물 효과가 적용된 아름다운 셰이더로 데모를 만들었습니다. 마치 수영장에서 물이 움직이는 것처럼 사실적으로 보입니다. 차분하고 최면에 걸린 듯한 느낌이 듭니다. 호버 시 3D 시차 효과...프로그램 작성 2024년 11월 16일에 게시됨

멋진 CodePen 데모(10월 4일)경량 물 왜곡 효과 Ksenia Kondrashova는 물 효과가 적용된 아름다운 셰이더로 데모를 만들었습니다. 마치 수영장에서 물이 움직이는 것처럼 사실적으로 보입니다. 차분하고 최면에 걸린 듯한 느낌이 듭니다. 호버 시 3D 시차 효과...프로그램 작성 2024년 11월 16일에 게시됨 -

`if` 문 너머: 명시적 `bool` 변환이 있는 유형을 형변환 없이 사용할 수 있는 다른 곳은 어디입니까?형변환 없이 허용되는 bool로의 상황별 변환귀하의 클래스는 bool로의 명시적인 변환을 정의하여 해당 인스턴스 't'를 조건문에서 직접 사용할 수 있도록 합니다. 그러나 이 명시적 변환은 다음과 같은 질문을 제기합니다. 캐스트 없이 't'...프로그램 작성 2024년 11월 16일에 게시됨

`if` 문 너머: 명시적 `bool` 변환이 있는 유형을 형변환 없이 사용할 수 있는 다른 곳은 어디입니까?형변환 없이 허용되는 bool로의 상황별 변환귀하의 클래스는 bool로의 명시적인 변환을 정의하여 해당 인스턴스 't'를 조건문에서 직접 사용할 수 있도록 합니다. 그러나 이 명시적 변환은 다음과 같은 질문을 제기합니다. 캐스트 없이 't'...프로그램 작성 2024년 11월 16일에 게시됨 -

Bootstrap 4 베타의 열 오프셋은 어떻게 되었나요?Bootstrap 4 베타: 열 오프셋 제거 및 복원Bootstrap 4는 베타 1 릴리스에서 열 오프셋 방식에 중요한 변경 사항을 도입했습니다. 열이 오프셋되었습니다. 그러나 후속 베타 2 릴리스에서는 이러한 변경 사항이 취소되었습니다.offset-md-*에서 ml-...프로그램 작성 2024년 11월 16일에 게시됨

Bootstrap 4 베타의 열 오프셋은 어떻게 되었나요?Bootstrap 4 베타: 열 오프셋 제거 및 복원Bootstrap 4는 베타 1 릴리스에서 열 오프셋 방식에 중요한 변경 사항을 도입했습니다. 열이 오프셋되었습니다. 그러나 후속 베타 2 릴리스에서는 이러한 변경 사항이 취소되었습니다.offset-md-*에서 ml-...프로그램 작성 2024년 11월 16일에 게시됨 -

실시간 통신을 위해 Go에서 WebSocket 사용채팅 애플리케이션, 실시간 알림, 협업 도구 등 실시간 업데이트가 필요한 앱을 구축하려면 기존 HTTP보다 더 빠르고 대화형인 통신 방법이 필요합니다. 이것이 바로 WebSockets가 필요한 곳입니다! 오늘은 Go에서 WebSocket을 사용하여 애플리케이션에 실시간...프로그램 작성 2024년 11월 16일에 게시됨

실시간 통신을 위해 Go에서 WebSocket 사용채팅 애플리케이션, 실시간 알림, 협업 도구 등 실시간 업데이트가 필요한 앱을 구축하려면 기존 HTTP보다 더 빠르고 대화형인 통신 방법이 필요합니다. 이것이 바로 WebSockets가 필요한 곳입니다! 오늘은 Go에서 WebSocket을 사용하여 애플리케이션에 실시간...프로그램 작성 2024년 11월 16일에 게시됨 -

각 행이 한 번만 계산되도록 하면서 SQL에서 값의 합계를 계산하는 방법은 무엇입니까?고유 값에 대해 SUM()을 사용하여 SQL에서 행 그룹화MySQL 쿼리에서 다음 값의 합계를 계산하려고 합니다. 각 행이 한 번만 계산되도록 전환표를 확인하세요. 이를 달성하려면 SUM() 함수와 함께 DISTINCT 키워드를 사용합니다. 그러나 중복 행이 SUM()...프로그램 작성 2024년 11월 16일에 게시됨

각 행이 한 번만 계산되도록 하면서 SQL에서 값의 합계를 계산하는 방법은 무엇입니까?고유 값에 대해 SUM()을 사용하여 SQL에서 행 그룹화MySQL 쿼리에서 다음 값의 합계를 계산하려고 합니다. 각 행이 한 번만 계산되도록 전환표를 확인하세요. 이를 달성하려면 SUM() 함수와 함께 DISTINCT 키워드를 사용합니다. 그러나 중복 행이 SUM()...프로그램 작성 2024년 11월 16일에 게시됨 -

MySQL을 사용하여 오늘 생일을 가진 사용자를 어떻게 찾을 수 있습니까?MySQL을 사용하여 오늘 생일이 있는 사용자를 식별하는 방법MySQL을 사용하여 오늘이 사용자의 생일인지 확인하려면 생일이 일치하는 모든 행을 찾는 것이 필요합니다. 오늘 날짜. 이는 UNIX 타임스탬프로 저장된 생일을 오늘 날짜와 비교하는 간단한 MySQL 쿼리를 ...프로그램 작성 2024년 11월 16일에 게시됨

MySQL을 사용하여 오늘 생일을 가진 사용자를 어떻게 찾을 수 있습니까?MySQL을 사용하여 오늘 생일이 있는 사용자를 식별하는 방법MySQL을 사용하여 오늘이 사용자의 생일인지 확인하려면 생일이 일치하는 모든 행을 찾는 것이 필요합니다. 오늘 날짜. 이는 UNIX 타임스탬프로 저장된 생일을 오늘 날짜와 비교하는 간단한 MySQL 쿼리를 ...프로그램 작성 2024년 11월 16일에 게시됨 -

Vite에서 환경 변수 처리현대 웹 개발에서는 API 키, 데이터베이스 자격 증명, 다양한 환경에 대한 다양한 구성과 같은 민감한 데이터를 관리하는 것이 필수적입니다. 이러한 변수를 코드에 직접 저장하면 보안 위험이 발생하고 배포가 복잡해질 수 있습니다. 최신 프런트엔드 빌드 도구인 Vite는 ...프로그램 작성 2024년 11월 16일에 게시됨

Vite에서 환경 변수 처리현대 웹 개발에서는 API 키, 데이터베이스 자격 증명, 다양한 환경에 대한 다양한 구성과 같은 민감한 데이터를 관리하는 것이 필수적입니다. 이러한 변수를 코드에 직접 저장하면 보안 위험이 발생하고 배포가 복잡해질 수 있습니다. 최신 프런트엔드 빌드 도구인 Vite는 ...프로그램 작성 2024년 11월 16일에 게시됨 -

Django REST Framework를 사용하여 중첩 직렬 변환기에서 외래 키 할당을 효율적으로 처리하는 방법은 무엇입니까?Django REST 프레임워크에서 중첩 직렬 변환기를 사용한 외래 키 할당Django REST 프레임워크(DRF)는 다음에서 외래 키 관계를 관리하는 편리한 방법을 제공합니다. 직렬화된 데이터. 그러나 중첩된 직렬 변환기에서 원하는 동작을 얻는 것은 어려울 수 있습니...프로그램 작성 2024년 11월 16일에 게시됨

Django REST Framework를 사용하여 중첩 직렬 변환기에서 외래 키 할당을 효율적으로 처리하는 방법은 무엇입니까?Django REST 프레임워크에서 중첩 직렬 변환기를 사용한 외래 키 할당Django REST 프레임워크(DRF)는 다음에서 외래 키 관계를 관리하는 편리한 방법을 제공합니다. 직렬화된 데이터. 그러나 중첩된 직렬 변환기에서 원하는 동작을 얻는 것은 어려울 수 있습니...프로그램 작성 2024년 11월 16일에 게시됨 -

CodeIgniter URL에서 "index.php"를 제거하는 방법은 무엇입니까?CodeIgniter .htaccess 및 URL 재작성 문제CodeIgniter 애플리케이션을 탐색하려면 URL에서 "index.php"를 제거해야 하는 경우가 많습니다. 더 깔끔한 구문을 갖춘 페이지. 그러나 신규 사용자는 이 프로세스에 어려움을 ...프로그램 작성 2024년 11월 16일에 게시됨

CodeIgniter URL에서 "index.php"를 제거하는 방법은 무엇입니까?CodeIgniter .htaccess 및 URL 재작성 문제CodeIgniter 애플리케이션을 탐색하려면 URL에서 "index.php"를 제거해야 하는 경우가 많습니다. 더 깔끔한 구문을 갖춘 페이지. 그러나 신규 사용자는 이 프로세스에 어려움을 ...프로그램 작성 2024년 11월 16일에 게시됨 -

``내부 요소' 태그 이상을 중첩할 수 있나요?흔하지 않은 HTML 구조: 이 이외의 태그를 수용할 수 있습니까?HTML 세계에서 중첩 태그는 다음을 생성할 수 있습니다. 복잡한 구조. 그러나 특정 태그의 배치가 제한되는 경우도 있습니다. 많은 사람들이 요소만 중첩할 수 있다고 생각하는 수수께끼의 태그를 사용...프로그램 작성 2024년 11월 16일에 게시됨

``내부 요소' 태그 이상을 중첩할 수 있나요?흔하지 않은 HTML 구조: 이 이외의 태그를 수용할 수 있습니까?HTML 세계에서 중첩 태그는 다음을 생성할 수 있습니다. 복잡한 구조. 그러나 특정 태그의 배치가 제한되는 경우도 있습니다. 많은 사람들이 요소만 중첩할 수 있다고 생각하는 수수께끼의 태그를 사용...프로그램 작성 2024년 11월 16일에 게시됨 -

XPath 조건을 사용하여 XML 문서에서 특정 노드를 선택하는 방법은 무엇입니까?노드 선택을 위한 XPath 조건 활용XPath를 통해 XML 문서를 탐색할 때 특정 기준에 따라 검색되는 노드를 제한해야 하는 경우가 많습니다. 이 예에서는 날짜 속성을 기반으로 노드를 선택적으로 검색하는 임무를 맡고 있습니다.다음 XPath 표현식은 제공된 XML ...프로그램 작성 2024년 11월 16일에 게시됨

XPath 조건을 사용하여 XML 문서에서 특정 노드를 선택하는 방법은 무엇입니까?노드 선택을 위한 XPath 조건 활용XPath를 통해 XML 문서를 탐색할 때 특정 기준에 따라 검색되는 노드를 제한해야 하는 경우가 많습니다. 이 예에서는 날짜 속성을 기반으로 노드를 선택적으로 검색하는 임무를 맡고 있습니다.다음 XPath 표현식은 제공된 XML ...프로그램 작성 2024년 11월 16일에 게시됨 -

절대 위치 요소에 \"margin: auto\"가 작동하지 않는 이유는 무엇입니까?절대 위치 여백 자동 문제 이해"margin-left: auto" 및 " margin-right: auto"를 입력하면 여백이 아무런 효과가 없는 것처럼 보일 수 있습니다. 이 동작은 여백이 예상대로 작동하는 "위치: 상대&...프로그램 작성 2024년 11월 16일에 게시됨

절대 위치 요소에 \"margin: auto\"가 작동하지 않는 이유는 무엇입니까?절대 위치 여백 자동 문제 이해"margin-left: auto" 및 " margin-right: auto"를 입력하면 여백이 아무런 효과가 없는 것처럼 보일 수 있습니다. 이 동작은 여백이 예상대로 작동하는 "위치: 상대&...프로그램 작성 2024년 11월 16일에 게시됨 -

Go는 메소드의 포인터와 값 수신자를 어떻게 처리합니까?Go 포인터: 수신기 및 값 유형Go에서 포인터는 객체 지향 프로그래밍과 메모리 관리를 이해하는 데 필수적입니다. 포인터를 다룰 때 메소드에서 수신자 유형 간의 차이를 파악하는 것이 중요합니다.제공한 Go Tour 예제는 이 개념을 보여줍니다.type Vertex st...프로그램 작성 2024년 11월 16일에 게시됨

Go는 메소드의 포인터와 값 수신자를 어떻게 처리합니까?Go 포인터: 수신기 및 값 유형Go에서 포인터는 객체 지향 프로그래밍과 메모리 관리를 이해하는 데 필수적입니다. 포인터를 다룰 때 메소드에서 수신자 유형 간의 차이를 파악하는 것이 중요합니다.제공한 Go Tour 예제는 이 개념을 보여줍니다.type Vertex st...프로그램 작성 2024년 11월 16일에 게시됨

중국어 공부

- 1 "걷다"를 중국어로 어떻게 말하나요? 走路 중국어 발음, 走路 중국어 학습

- 2 "비행기를 타다"를 중국어로 어떻게 말하나요? 坐飞机 중국어 발음, 坐飞机 중국어 학습

- 3 "기차를 타다"를 중국어로 어떻게 말하나요? 坐火车 중국어 발음, 坐火车 중국어 학습

- 4 "버스를 타다"를 중국어로 어떻게 말하나요? 坐车 중국어 발음, 坐车 중국어 학습

- 5 운전을 중국어로 어떻게 말하나요? 开车 중국어 발음, 开车 중국어 학습

- 6 수영을 중국어로 뭐라고 하나요? 游泳 중국어 발음, 游泳 중국어 학습

- 7 자전거를 타다 중국어로 뭐라고 하나요? 骑自行车 중국어 발음, 骑自行车 중국어 학습

- 8 중국어로 안녕하세요를 어떻게 말해요? 你好중국어 발음, 你好중국어 학습

- 9 감사합니다를 중국어로 어떻게 말하나요? 谢谢중국어 발음, 谢谢중국어 학습

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning