रेसनेट बनाम एफिशिएंटनेट बनाम वीजीजी बनाम एनएन

एक छात्र के रूप में, मैंने हमारे विश्वविद्यालय की अकुशल खोया और पाया प्रणाली के कारण उत्पन्न निराशा को प्रत्यक्ष रूप से देखा है। मौजूदा प्रक्रिया, जो प्रत्येक पाए गए आइटम के लिए अलग-अलग ईमेल पर निर्भर करती है, अक्सर खोए हुए सामान और उनके मालिकों के बीच देरी और कनेक्शन छूटने का कारण बनती है।

अपने और अपने साथी छात्रों के लिए इस अनुभव को बेहतर बनाने की इच्छा से प्रेरित होकर, मैंने हमारी खोई और पाई प्रणाली में क्रांतिकारी बदलाव लाने के लिए गहन शिक्षा की क्षमता का पता लगाने के लिए एक परियोजना शुरू की है। इस ब्लॉग पोस्ट में, मैं खोई हुई वस्तुओं की पहचान और वर्गीकरण को स्वचालित करने के लिए पूर्व-प्रशिक्षित मॉडल - रेसनेट, एफिशिएंटनेट, वीजीजी, और नैसनेट - के मूल्यांकन की अपनी यात्रा साझा करूंगा।

एक तुलनात्मक विश्लेषण के माध्यम से, मेरा लक्ष्य हमारे सिस्टम में एकीकृत करने के लिए सबसे उपयुक्त मॉडल को इंगित करना है, जो अंततः परिसर में सभी के लिए एक तेज़, अधिक सटीक और उपयोगकर्ता के अनुकूल खोया और पाया अनुभव तैयार करेगा।

रेसनेट

इंसेप्शन-रेसनेट वी2 केरास में उपलब्ध एक शक्तिशाली कनवल्शनल न्यूरल नेटवर्क आर्किटेक्चर है, जो रेसनेट के अवशिष्ट कनेक्शन के साथ इंसेप्शन आर्किटेक्चर की ताकत को जोड़ता है। इस हाइब्रिड मॉडल का लक्ष्य कम्प्यूटेशनल दक्षता बनाए रखते हुए छवि वर्गीकरण कार्यों में उच्च सटीकता प्राप्त करना है।

प्रशिक्षण डेटासेट: इमेजनेट

छवि प्रारूप: 299 x 299

प्रीप्रोसेसिंग फ़ंक्शन

def readyForResNet(fileName):

pic = load_img(fileName, target_size=(299, 299))

pic_array = img_to_array(pic)

expanded = np.expand_dims(pic_array, axis=0)

return preprocess_input_resnet(expanded)

भविष्यवाणी

data1 = readyForResNet(test_file) prediction = inception_model_resnet.predict(data1) res1 = decode_predictions_resnet(prediction, top=2)

वीजीजी (विजुअल ज्योमेट्री ग्रुप)

वीजीजी (विज़ुअल ज्योमेट्री ग्रुप) गहरे दृढ़ तंत्रिका नेटवर्क आर्किटेक्चर का एक परिवार है जो छवि वर्गीकरण कार्यों में अपनी सादगी और प्रभावशीलता के लिए जाना जाता है। इन मॉडलों, विशेष रूप से वीजीजी16 और वीजीजी19, ने 2014 में इमेजनेट लार्ज स्केल विजुअल रिकॉग्निशन चैलेंज (आईएलएसवीआरसी) में अपने मजबूत प्रदर्शन के कारण लोकप्रियता हासिल की।

प्रशिक्षण डेटासेट: इमेजनेट

छवि प्रारूप: 224 x 224

प्रीप्रोसेसिंग फ़ंक्शन

def readyForVGG(fileName):

pic = load_img(fileName, target_size=(224, 224))

pic_array = img_to_array(pic)

expanded = np.expand_dims(pic_array, axis=0)

return preprocess_input_vgg19(expanded)

भविष्यवाणी

data2 = readyForVGG(test_file) prediction = inception_model_vgg19.predict(data2) res2 = decode_predictions_vgg19(prediction, top=2)

कुशल नेट

एफिशिएंटनेट कनवल्शनल न्यूरल नेटवर्क आर्किटेक्चर का एक परिवार है जो पिछले मॉडलों की तुलना में काफी छोटा और तेज़ होने के साथ-साथ छवि वर्गीकरण कार्यों पर अत्याधुनिक सटीकता प्राप्त करता है। यह दक्षता एक नवीन कंपाउंड स्केलिंग विधि के माध्यम से हासिल की जाती है जो नेटवर्क की गहराई, चौड़ाई और रिज़ॉल्यूशन को संतुलित करती है।

प्रशिक्षण डेटासेट: इमेजनेट

छवि प्रारूप: 480 x 480

प्रीप्रोसेसिंग फ़ंक्शन

def readyForEF(fileName):

pic = load_img(fileName, target_size=(480, 480))

pic_array = img_to_array(pic)

expanded = np.expand_dims(pic_array, axis=0)

return preprocess_input_EF(expanded)

भविष्यवाणी

data3 = readyForEF(test_file) prediction = inception_model_EF.predict(data3) res3 = decode_predictions_EF(prediction, top=2)

नैसनेट

NasNet (न्यूरल आर्किटेक्चर सर्च नेटवर्क) गहन शिक्षण में एक अभूतपूर्व दृष्टिकोण का प्रतिनिधित्व करता है जहां तंत्रिका नेटवर्क की वास्तुकला को एक स्वचालित खोज प्रक्रिया के माध्यम से खोजा जाता है। इस खोज प्रक्रिया का लक्ष्य किसी दिए गए कार्य पर उच्च प्रदर्शन प्राप्त करने के लिए परतों और कनेक्शनों का इष्टतम संयोजन ढूंढना है।

प्रशिक्षण डेटासेट: इमेजनेट

छवि प्रारूप: 224 x 224

प्रीप्रोसेसिंग फ़ंक्शन

def readyForNN(fileName):

pic = load_img(fileName, target_size=(224, 224))

pic_array = img_to_array(pic)

expanded = np.expand_dims(pic_array, axis=0)

return preprocess_input_NN(expanded)

भविष्यवाणी

data4 = readyForNN(test_file) prediction = inception_model_NN.predict(data4) res4 = decode_predictions_NN(prediction, top=2)

तसलीम

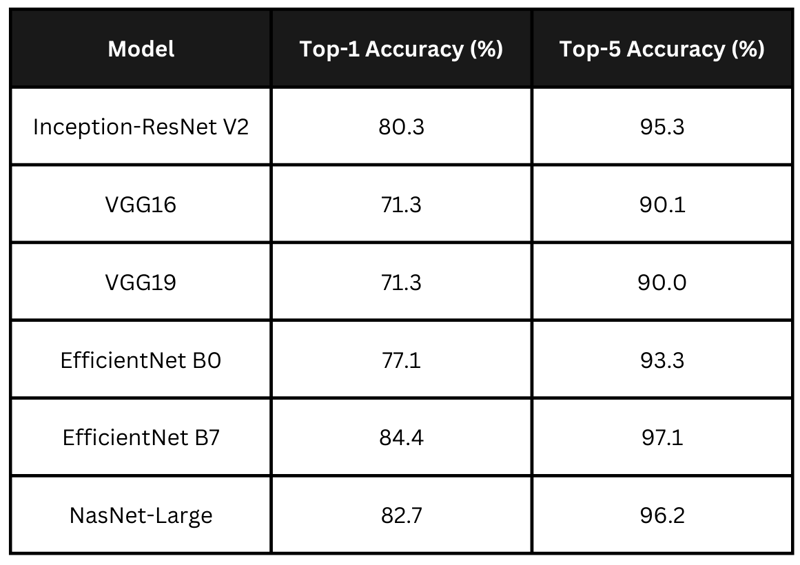

शुद्धता

तालिका उपरोक्त मॉडलों के दावा किए गए सटीकता स्कोर का सारांश प्रस्तुत करती है। एफिशिएंटनेट बी7 उच्चतम सटीकता के साथ आगे है, उसके बाद नैसनेट-लार्ज और इंसेप्शन-रेसनेट वी2 हैं। वीजीजी मॉडल कम सटीकता प्रदर्शित करते हैं। अपने एप्लिकेशन के लिए मैं एक ऐसा मॉडल चुनना चाहता हूं जिसमें प्रसंस्करण समय और सटीकता के बीच संतुलन हो।

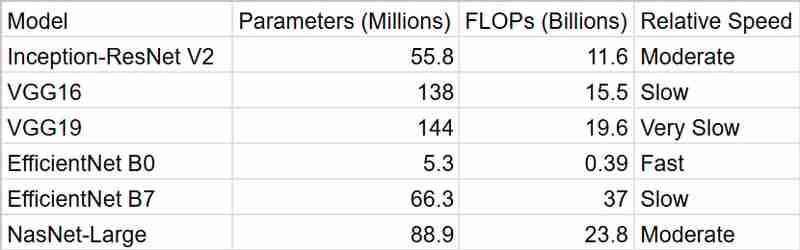

समय

जैसा कि हम देख सकते हैं, EfficientNetB0 हमें सबसे तेज़ परिणाम प्रदान करता है, लेकिन सटीकता को ध्यान में रखते हुए InceptionResNetV2 एक बेहतर पैकेज है

सारांश

अपने स्मार्ट खोया और पाया सिस्टम के लिए, मैंने InceptionResNetV2 के साथ जाने का फैसला किया। जबकि एफिशिएंटनेट बी7 अपनी सर्वोच्च सटीकता के साथ आकर्षक लग रहा था, मैं इसकी कम्प्यूटेशनल मांगों के बारे में चिंतित था। एक विश्वविद्यालय सेटिंग में, जहां संसाधन सीमित हो सकते हैं और वास्तविक समय का प्रदर्शन अक्सर वांछनीय होता है, मुझे लगा कि सटीकता और दक्षता के बीच संतुलन बनाना महत्वपूर्ण है। InceptionResNetV2 एकदम फिट लग रहा था - यह अत्यधिक कम्प्यूटेशनल गहनता के बिना मजबूत प्रदर्शन प्रदान करता है।

साथ ही, यह तथ्य कि यह इमेजनेट पर पूर्व-प्रशिक्षित है, मुझे विश्वास दिलाता है कि यह लोगों द्वारा खोई जा सकने वाली विभिन्न प्रकार की वस्तुओं को संभाल सकता है। और हमें यह नहीं भूलना चाहिए कि केरस में काम करना कितना आसान है! इससे निश्चित रूप से मेरा निर्णय आसान हो गया।

कुल मिलाकर, मेरा मानना है कि InceptionResNetV2 मेरे प्रोजेक्ट के लिए सटीकता, दक्षता और व्यावहारिकता का सही मिश्रण प्रदान करता है। मैं यह देखने के लिए उत्साहित हूं कि यह खोई हुई वस्तुओं को उनके मालिकों से मिलाने में कैसा प्रदर्शन करता है!

-

जब गोइंग भाषा को स्लाइस करना है तो मेमोरी लीक से कैसे बचें?] इस लेख का उद्देश्य स्लाइसिंग और उनके संभावित परिणामों के लिए दो दृष्टिकोणों की जांच करके स्पष्टीकरण प्रदान करना है। हालांकि यह आम तौर पर कुशल है, यह...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

जब गोइंग भाषा को स्लाइस करना है तो मेमोरी लीक से कैसे बचें?] इस लेख का उद्देश्य स्लाइसिंग और उनके संभावित परिणामों के लिए दो दृष्टिकोणों की जांच करके स्पष्टीकरण प्रदान करना है। हालांकि यह आम तौर पर कुशल है, यह...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

गुमनाम जावास्क्रिप्ट इवेंट हैंडलर को साफ -सुथरा कैसे निकालें?] तत्व? तत्व। जब तक हैंडलर का संदर्भ निर्माण में संग्रहीत नहीं किया गया था, तब तक एक गुमनाम इवेंट हैंडलर को साफ करने का कोई तरीका नहीं है। यह आवश्...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

गुमनाम जावास्क्रिप्ट इवेंट हैंडलर को साफ -सुथरा कैसे निकालें?] तत्व? तत्व। जब तक हैंडलर का संदर्भ निर्माण में संग्रहीत नहीं किया गया था, तब तक एक गुमनाम इवेंट हैंडलर को साफ करने का कोई तरीका नहीं है। यह आवश्...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

जावास्क्रिप्ट ऑब्जेक्ट्स में गतिशील रूप से चाबियां कैसे सेट करें?] सही दृष्टिकोण वर्ग कोष्ठक को नियोजित करता है: jsobj ['कुंजी' i] = 'उदाहरण' 1; जावास्क्रिप्ट में, सरणियाँ एक विशेष प्रकार का ऑ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

जावास्क्रिप्ट ऑब्जेक्ट्स में गतिशील रूप से चाबियां कैसे सेट करें?] सही दृष्टिकोण वर्ग कोष्ठक को नियोजित करता है: jsobj ['कुंजी' i] = 'उदाहरण' 1; जावास्क्रिप्ट में, सरणियाँ एक विशेष प्रकार का ऑ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

Eval () बनाम ast.literal_eval (): उपयोगकर्ता इनपुट के लिए कौन सा पायथन फ़ंक्शन सुरक्षित है?] eval (), एक शक्तिशाली पायथन फ़ंक्शन, अक्सर एक संभावित समाधान के रूप में उत्पन्न होता है, लेकिन चिंताएं इसके संभावित जोखिमों को घेरती हैं। यह लेख eva...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

Eval () बनाम ast.literal_eval (): उपयोगकर्ता इनपुट के लिए कौन सा पायथन फ़ंक्शन सुरक्षित है?] eval (), एक शक्तिशाली पायथन फ़ंक्शन, अक्सर एक संभावित समाधान के रूप में उत्पन्न होता है, लेकिन चिंताएं इसके संभावित जोखिमों को घेरती हैं। यह लेख eva...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

संकलक त्रुटि "USR/BIN/LD: नहीं मिल सकती है -L" समाधान] -l यह त्रुटि इंगित करती है कि लिंकर आपके निष्पादन योग्य को जोड़ते समय निर्दिष्ट लाइब्रेरी का पता नहीं लगा सकता है। इस समस्या को हल करने के लिए, ह...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

संकलक त्रुटि "USR/BIN/LD: नहीं मिल सकती है -L" समाधान] -l यह त्रुटि इंगित करती है कि लिंकर आपके निष्पादन योग्य को जोड़ते समय निर्दिष्ट लाइब्रेरी का पता नहीं लगा सकता है। इस समस्या को हल करने के लिए, ह...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

`JSON` पैकेज का उपयोग करके जाने में JSON सरणियों को कैसे पार्स करें?उदाहरण: निम्नलिखित गो कोड पर विचार करें: सरणी [] स्ट्रिंग } func मुख्य () { datajson: = `[" 1 "," 2 "," 3 "...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

`JSON` पैकेज का उपयोग करके जाने में JSON सरणियों को कैसे पार्स करें?उदाहरण: निम्नलिखित गो कोड पर विचार करें: सरणी [] स्ट्रिंग } func मुख्य () { datajson: = `[" 1 "," 2 "," 3 "...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

लेम्ब्डा अभिव्यक्तियों को जावा में "अंतिम" या "वैध अंतिम" चर की आवश्यकता क्यों है?] अंतिम। कोड स्निपेट में प्रदान किया गया: // कोड गायब है cal.getComponents ()। getCompenents ("vTimeZone") // कोड गायब है...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

लेम्ब्डा अभिव्यक्तियों को जावा में "अंतिम" या "वैध अंतिम" चर की आवश्यकता क्यों है?] अंतिम। कोड स्निपेट में प्रदान किया गया: // कोड गायब है cal.getComponents ()। getCompenents ("vTimeZone") // कोड गायब है...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

दशमलव का उपयोग करके घातीय संकेतन में संख्या को कैसे पार्स करें।] ऐसा इसलिए है क्योंकि डिफ़ॉल्ट पार्सिंग विधि घातीय संकेतन को पहचान नहींती है। इस तरह के स्ट्रिंग को सफलतापूर्वक पार्स करने के लिए, आपको स्पष्ट रूप ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

दशमलव का उपयोग करके घातीय संकेतन में संख्या को कैसे पार्स करें।] ऐसा इसलिए है क्योंकि डिफ़ॉल्ट पार्सिंग विधि घातीय संकेतन को पहचान नहींती है। इस तरह के स्ट्रिंग को सफलतापूर्वक पार्स करने के लिए, आपको स्पष्ट रूप ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

मैं पायथन का उपयोग करके रिवर्स ऑर्डर में एक बड़ी फ़ाइल को कुशलता से कैसे पढ़ सकता हूं?] इस कार्य से निपटने के लिए एक कुशल समाधान है: रिवर्स लाइन रीडर जनरेटर निम्न कोड एक जनरेटर फ़ंक्शन को परिभाषित करता है, reverse_readline, जो ए...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

मैं पायथन का उपयोग करके रिवर्स ऑर्डर में एक बड़ी फ़ाइल को कुशलता से कैसे पढ़ सकता हूं?] इस कार्य से निपटने के लिए एक कुशल समाधान है: रिवर्स लाइन रीडर जनरेटर निम्न कोड एक जनरेटर फ़ंक्शन को परिभाषित करता है, reverse_readline, जो ए...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

गो में SQL प्रश्नों का निर्माण करते समय मैं सुरक्षित रूप से पाठ और मूल्यों को कैसे सहमत कर सकता हूं?] दृष्टिकोण जाने में मान्य नहीं है, और मापदंडों को कास्ट करने का प्रयास करने के लिए स्ट्रिंग्स के परिणामस्वरूप बेमेल त्रुटियां होती हैं। यह आपको रनटाइ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

गो में SQL प्रश्नों का निर्माण करते समय मैं सुरक्षित रूप से पाठ और मूल्यों को कैसे सहमत कर सकता हूं?] दृष्टिकोण जाने में मान्य नहीं है, और मापदंडों को कास्ट करने का प्रयास करने के लिए स्ट्रिंग्स के परिणामस्वरूप बेमेल त्रुटियां होती हैं। यह आपको रनटाइ...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

Fastapi कस्टम 404 पृष्ठ निर्माण गाइड] उपयुक्त विधि आपकी विशिष्ट आवश्यकताओं पर निर्भर करती है। call_next (अनुरोध) यदि response.status_code == 404: REDIRECTRESPONSE ("https://fast...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

Fastapi कस्टम 404 पृष्ठ निर्माण गाइड] उपयुक्त विधि आपकी विशिष्ट आवश्यकताओं पर निर्भर करती है। call_next (अनुरोध) यदि response.status_code == 404: REDIRECTRESPONSE ("https://fast...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

पायथन पढ़ें CSV फ़ाइल Unicodedecodeerror अल्टीमेट सॉल्यूशनडिकोड बाइट्स स्थिति 2-3 में: truncated \ uxxxxxxxxx escape यह त्रुटि तब होती है जब CSV फ़ाइल के पथ में विशेष वर्ण होते हैं या यूनिकोड होता है कि पा...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

पायथन पढ़ें CSV फ़ाइल Unicodedecodeerror अल्टीमेट सॉल्यूशनडिकोड बाइट्स स्थिति 2-3 में: truncated \ uxxxxxxxxx escape यह त्रुटि तब होती है जब CSV फ़ाइल के पथ में विशेष वर्ण होते हैं या यूनिकोड होता है कि पा...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

Chatbot कमांड निष्पादन के लिए वास्तविक समय में कैसे कैप्चर और स्ट्रीम करें?] हालाँकि, वास्तविक समय में स्टडआउट को पुनः प्राप्त करने का प्रयास करते समय चुनौतियां उत्पन्न होती हैं। इसे दूर करने के लिए, हमें स्क्रिप्ट के निष्पाद...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

Chatbot कमांड निष्पादन के लिए वास्तविक समय में कैसे कैप्चर और स्ट्रीम करें?] हालाँकि, वास्तविक समय में स्टडआउट को पुनः प्राप्त करने का प्रयास करते समय चुनौतियां उत्पन्न होती हैं। इसे दूर करने के लिए, हमें स्क्रिप्ट के निष्पाद...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

आप Laravel ब्लेड टेम्प्लेट में चर को कैसे परिभाषित कर सकते हैं?] "{{}}}" का उपयोग करके चर असाइन करते समय, यह सीधा है, यह हमेशा सबसे सुरुचिपूर्ण समाधान नहीं हो सकता है। $ old_section = "जो भी"...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

आप Laravel ब्लेड टेम्प्लेट में चर को कैसे परिभाषित कर सकते हैं?] "{{}}}" का उपयोग करके चर असाइन करते समय, यह सीधा है, यह हमेशा सबसे सुरुचिपूर्ण समाधान नहीं हो सकता है। $ old_section = "जो भी"...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया -

क्या आप Chrome और फ़ायरफ़ॉक्स में CSS को कंसोल आउटपुट का उपयोग कर सकते हैं?] संदेश? इसे प्राप्त करने के लिए, निम्नलिखित पैटर्न का उपयोग करें: कंसोल.लॉग (' %C ओह माय हैवेन्स!', 'बैकग्राउंड: #222; रंग: #bada55'...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

क्या आप Chrome और फ़ायरफ़ॉक्स में CSS को कंसोल आउटपुट का उपयोग कर सकते हैं?] संदेश? इसे प्राप्त करने के लिए, निम्नलिखित पैटर्न का उपयोग करें: कंसोल.लॉग (' %C ओह माय हैवेन्स!', 'बैकग्राउंड: #222; रंग: #bada55'...प्रोग्रामिंग 2025-07-09 पर पोस्ट किया गया

चीनी भाषा का अध्ययन करें

- 1 आप चीनी भाषा में "चलना" कैसे कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 2 आप चीनी भाषा में "विमान ले लो" कैसे कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 3 आप चीनी भाषा में "ट्रेन ले लो" कैसे कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 4 आप चीनी भाषा में "बस ले लो" कैसे कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 5 चीनी भाषा में ड्राइव को क्या कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 6 तैराकी को चीनी भाषा में क्या कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 7 आप चीनी भाषा में साइकिल चलाने को क्या कहते हैं? #का चीनी उच्चारण, #का चीनी सीखना

- 8 आप चीनी भाषा में नमस्ते कैसे कहते हैं? 你好चीनी उच्चारण, 你好चीनी सीखना

- 9 आप चीनी भाषा में धन्यवाद कैसे कहते हैं? 谢谢चीनी उच्चारण, 谢谢चीनी सीखना

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning