Página delantera > Programación > Entropix: técnicas de muestreo para maximizar el rendimiento de la inferencia

Página delantera > Programación > Entropix: técnicas de muestreo para maximizar el rendimiento de la inferencia

Entropix: técnicas de muestreo para maximizar el rendimiento de la inferencia

Entropix: técnicas de muestreo para maximizar el rendimiento de la inferencia

Según Entropix README, Entropix utiliza un método de muestreo basado en entropía. Este artículo explica las técnicas de muestreo específicas basadas en entropía y varentropía.

Entropía y varentropía

Comencemos explicando la entropía y la varentropía, ya que son factores clave para determinar la estrategia de muestreo.

entropía

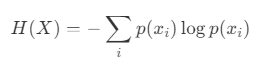

En teoría de la información, la entropía es una medida de la incertidumbre de una variable aleatoria. La entropía de una variable aleatoria X está definida por la siguiente ecuación:

- X: Una variable aleatoria discreta.

- x_i: El i-ésimo estado posible de X.

- p(x_i): La probabilidad del estado x_i.

La entropía se maximiza cuando la distribución de probabilidad es uniforme. Por el contrario, cuando un estado específico es mucho más probable que otros, la entropía disminuye.

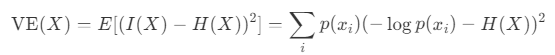

Varentropía

La varentropía, estrechamente relacionada con la entropía, representa la variabilidad en el contenido de la información. Considerando el contenido de información I(X), la entropía H(X) y la varianza de una variable aleatoria X, la varentropía V E(X) se define de la siguiente manera:

La varentropía se vuelve grande cuando las probabilidades p(x_i) varían mucho. Se vuelve pequeño cuando las probabilidades son uniformes, ya sea cuando la distribución tiene la máxima entropía o cuando un valor tiene una probabilidad de 1 y todos los demás tienen una probabilidad de 0.

Métodos de muestreo

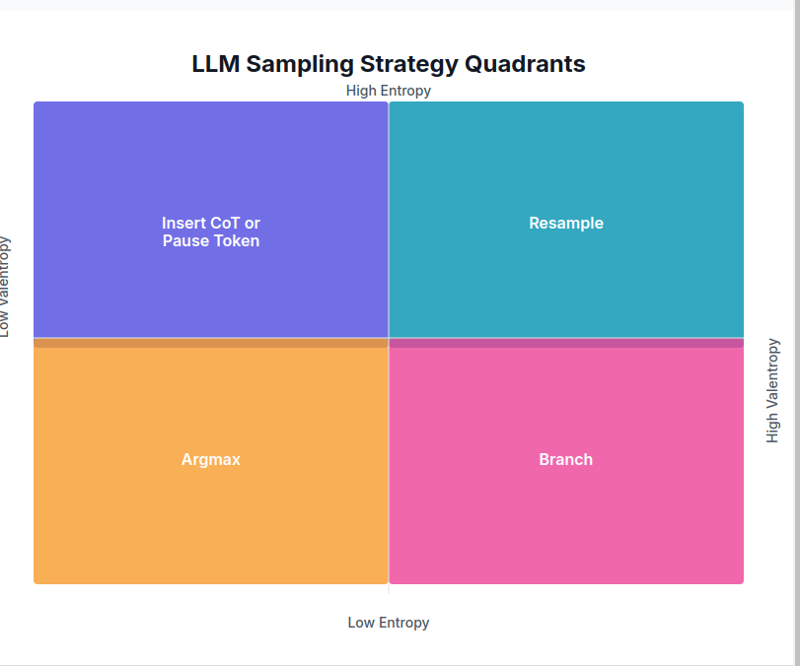

A continuación, exploremos cómo cambian las estrategias de muestreo según los valores de entropía y varentropía.

1. Baja entropía, baja varentropía → Argmax

En este escenario, un token en particular tiene una probabilidad de predicción mucho mayor que los demás. Dado que el próximo token es casi seguro, se utiliza Argmax.

if entEnlace de código

2. Baja entropía, alta varentropía → Rama

Esto ocurre cuando hay cierta confianza, pero existen múltiples opciones viables. En este caso, la estrategia Sucursal se utiliza para muestrear entre múltiples opciones y seleccionar el mejor resultado.

elif ent 5.0: temp_adj = 1.2 0.3 * interaction_strength top_k_adj = max(5, int(top_k * (1 0.5 * (1 - agreement)))) return _sample(logits, temperature=min(1.5, temperature * temp_adj), top_p=top_p, top_k=top_k_adj, min_p=min_p, generator=generator)Enlace de código

Aunque esta estrategia se llama "Rama", el código actual parece ajustar el rango de muestreo y seleccionar una única ruta. (Si alguien tiene más información, se agradecería una mayor aclaración).

3. Alta entropía, baja varentropía → CoT o Insertar token de pausa

Cuando las probabilidades de predicción del siguiente token son bastante uniformes, lo que indica que el siguiente contexto no es seguro, se inserta un token de aclaración para resolver la ambigüedad.

elif ent > 3.0 and ventEnlace de código

4. Alta entropía, alta varentropía → Remuestreo

En este caso, hay múltiples contextos y las probabilidades de predicción del siguiente token son bajas. Se utiliza una estrategia de remuestreo con un ajuste de temperatura más alto y una p superior más baja.

elif ent > 5.0 and vent > 5.0: temp_adj = 2.0 0.5 * attn_vent top_p_adj = max(0.5, top_p - 0.2 * attn_ent) return _sample(logits, temperature=max(2.0, temperature * temp_adj), top_p=top_p_adj, top_k=top_k, min_p=min_p, generator=generator)Enlace de código

Casos intermedios

Si no se cumple ninguna de las condiciones anteriores, se realiza muestreo adaptativo. Se toman varias muestras y se calcula la mejor puntuación de muestreo en función de la información de entropía, varentropía y atención.

else: return adaptive_sample( logits, metrics, gen_tokens, n_samples=5, base_temp=temperature, base_top_p=top_p, base_top_k=top_k, generator=generator )Enlace de código

Referencias

- Repositorio Entropix

- ¿Qué está haciendo Entropix?

-

¿Cómo puedo recuperar eficientemente los valores de atributos de los archivos XML usando PHP?Recuperando valores de atributo de archivos XML en php Todo desarrollador encuentra la necesidad de analizar archivos XML y extraer valores es...Programación Publicado el 2025-07-17

¿Cómo puedo recuperar eficientemente los valores de atributos de los archivos XML usando PHP?Recuperando valores de atributo de archivos XML en php Todo desarrollador encuentra la necesidad de analizar archivos XML y extraer valores es...Programación Publicado el 2025-07-17 -

¿Se pueden apilar múltiples elementos adhesivos uno encima del otro en CSS puro?¿Es posible tener múltiples elementos pegajosos apilados uno encima del otro en CSS puro? El comportamiento deseado se puede ver Aquí: https...Programación Publicado el 2025-07-17

¿Se pueden apilar múltiples elementos adhesivos uno encima del otro en CSS puro?¿Es posible tener múltiples elementos pegajosos apilados uno encima del otro en CSS puro? El comportamiento deseado se puede ver Aquí: https...Programación Publicado el 2025-07-17 -

¿Por qué recibo un error de \ "clase \ 'Ziparchive \' no encontrado \" después de instalar Archive_Zip en mi servidor Linux?class 'Ziparchive' no encontrado Error al instalar Archive_Zip en Linux Server Sytom: cuando intentan ejecutar un script que utiliza...Programación Publicado el 2025-07-17

¿Por qué recibo un error de \ "clase \ 'Ziparchive \' no encontrado \" después de instalar Archive_Zip en mi servidor Linux?class 'Ziparchive' no encontrado Error al instalar Archive_Zip en Linux Server Sytom: cuando intentan ejecutar un script que utiliza...Programación Publicado el 2025-07-17 -

¿Cómo cargar archivos con parámetros adicionales utilizando java.net.urlconnection y codificación multipart/formulario?de carga de archivos con solicitudes http para cargar archivos a un servidor HTTP al tiempo que envía parámetros adicionales, java.net.urlconn...Programación Publicado el 2025-07-17

¿Cómo cargar archivos con parámetros adicionales utilizando java.net.urlconnection y codificación multipart/formulario?de carga de archivos con solicitudes http para cargar archivos a un servidor HTTP al tiempo que envía parámetros adicionales, java.net.urlconn...Programación Publicado el 2025-07-17 -

¿Cómo descubrir dinámicamente los tipos de paquetes de exportación en el idioma GO?para encontrar tipos de paquetes exportados dinámicamente en contraste con las capacidades de descubrimiento de tipo limitado en el paquete re...Programación Publicado el 2025-07-17

¿Cómo descubrir dinámicamente los tipos de paquetes de exportación en el idioma GO?para encontrar tipos de paquetes exportados dinámicamente en contraste con las capacidades de descubrimiento de tipo limitado en el paquete re...Programación Publicado el 2025-07-17 -

Python forma eficiente de eliminar las etiquetas HTML del textoeliminando las etiquetas HTML en Python para una representación textual prístina manipular las respuestas HTML a menudo implica extraer conten...Programación Publicado el 2025-07-17

Python forma eficiente de eliminar las etiquetas HTML del textoeliminando las etiquetas HTML en Python para una representación textual prístina manipular las respuestas HTML a menudo implica extraer conten...Programación Publicado el 2025-07-17 -

¿Cómo limitar el rango de desplazamiento de un elemento dentro de un elemento principal de tamaño dinámico?implementando límites de altura de CSS para los elementos de desplazamiento vertical en una interfaz interactiva, controlar el comportamiento ...Programación Publicado el 2025-07-17

¿Cómo limitar el rango de desplazamiento de un elemento dentro de un elemento principal de tamaño dinámico?implementando límites de altura de CSS para los elementos de desplazamiento vertical en una interfaz interactiva, controlar el comportamiento ...Programación Publicado el 2025-07-17 -

Método para convertir correctamente los caracteres LATIN1 en UTF8 en UTF8 MySQL Tableconverse los caracteres latin1 en una tabla utf8 a utf8 ha encontrado un problema donde los caracteres con diacrísos "mysql_set_charset (...Programación Publicado el 2025-07-17

Método para convertir correctamente los caracteres LATIN1 en UTF8 en UTF8 MySQL Tableconverse los caracteres latin1 en una tabla utf8 a utf8 ha encontrado un problema donde los caracteres con diacrísos "mysql_set_charset (...Programación Publicado el 2025-07-17 -

¿Cómo convertir eficientemente las zonas horarias en PHP?Conversión de zona horaria eficiente en php en PHP, el manejo de las zonas horarias puede ser una tarea directa. Esta guía proporcionará un méto...Programación Publicado el 2025-07-17

¿Cómo convertir eficientemente las zonas horarias en PHP?Conversión de zona horaria eficiente en php en PHP, el manejo de las zonas horarias puede ser una tarea directa. Esta guía proporcionará un méto...Programación Publicado el 2025-07-17 -

¿Cómo corregir \ "mysql_config no encontrado \" error al instalar mysql-python en Ubuntu/Linux?mysql-python Error de instalación: "mysql_config no encontrado" intentando instalar mysql-python en ubuntu/linux box puede encontrar...Programación Publicado el 2025-07-17

¿Cómo corregir \ "mysql_config no encontrado \" error al instalar mysql-python en Ubuntu/Linux?mysql-python Error de instalación: "mysql_config no encontrado" intentando instalar mysql-python en ubuntu/linux box puede encontrar...Programación Publicado el 2025-07-17 -

¿Cómo los map.entry de Java y simplificando la gestión de pares de valores clave?una colección integral para pares de valor: Introducción de Java Map.entry y SimpleEntry en Java, al definir una colección donde cada elemento...Programación Publicado el 2025-07-17

¿Cómo los map.entry de Java y simplificando la gestión de pares de valores clave?una colección integral para pares de valor: Introducción de Java Map.entry y SimpleEntry en Java, al definir una colección donde cada elemento...Programación Publicado el 2025-07-17 -

¿Cómo crear una animación CSS suave de izquierda-derecha para un DIV dentro de su contenedor?animación CSS genérica para el movimiento de derecha izquierda En este artículo, exploraremos la creación de una animación genérica de CSS par...Programación Publicado el 2025-07-17

¿Cómo crear una animación CSS suave de izquierda-derecha para un DIV dentro de su contenedor?animación CSS genérica para el movimiento de derecha izquierda En este artículo, exploraremos la creación de una animación genérica de CSS par...Programación Publicado el 2025-07-17 -

Fit de objeto: la cubierta falla en IE y Edge, ¿cómo solucionar?Object-Fit: la portada falla en IE y Edge, ¿cómo solucionar? utilizando objeto-fit: cover; en CSS para mantener la altura de imagen consistent...Programación Publicado el 2025-07-17

Fit de objeto: la cubierta falla en IE y Edge, ¿cómo solucionar?Object-Fit: la portada falla en IE y Edge, ¿cómo solucionar? utilizando objeto-fit: cover; en CSS para mantener la altura de imagen consistent...Programación Publicado el 2025-07-17 -

Resuelve la excepción \\ "Valor de cadena \\" cuando MySQL inserta emojiresolviendo una excepción de valor de cadena incorrecta al insertar emOJi Al intentar insertar una cadena que contenga caracteres emOJi en una b...Programación Publicado el 2025-07-17

Resuelve la excepción \\ "Valor de cadena \\" cuando MySQL inserta emojiresolviendo una excepción de valor de cadena incorrecta al insertar emOJi Al intentar insertar una cadena que contenga caracteres emOJi en una b...Programación Publicado el 2025-07-17 -

¿Por qué Java no puede crear matrices genéricas?Error de creación de matriz genérica pregunta: cuando intentan crear una variedad de clases genéricas usando una expresión como: Public st...Programación Publicado el 2025-07-17

¿Por qué Java no puede crear matrices genéricas?Error de creación de matriz genérica pregunta: cuando intentan crear una variedad de clases genéricas usando una expresión como: Public st...Programación Publicado el 2025-07-17

Estudiar chino

- 1 ¿Cómo se dice "caminar" en chino? 走路 pronunciación china, 走路 aprendizaje chino

- 2 ¿Cómo se dice "tomar un avión" en chino? 坐飞机 pronunciación china, 坐飞机 aprendizaje chino

- 3 ¿Cómo se dice "tomar un tren" en chino? 坐火车 pronunciación china, 坐火车 aprendizaje chino

- 4 ¿Cómo se dice "tomar un autobús" en chino? 坐车 pronunciación china, 坐车 aprendizaje chino

- 5 ¿Cómo se dice conducir en chino? 开车 pronunciación china, 开车 aprendizaje chino

- 6 ¿Cómo se dice nadar en chino? 游泳 pronunciación china, 游泳 aprendizaje chino

- 7 ¿Cómo se dice andar en bicicleta en chino? 骑自行车 pronunciación china, 骑自行车 aprendizaje chino

- 8 ¿Cómo se dice hola en chino? 你好Pronunciación china, 你好Aprendizaje chino

- 9 ¿Cómo se dice gracias en chino? 谢谢Pronunciación china, 谢谢Aprendizaje chino

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning