So schützen Sie Ihre Kunstwerke mit Nightshade vor generativer KI

KI-Tools sind revolutionär und können jetzt Gespräche führen, menschenähnlichen Text generieren und Bilder basierend auf einem einzigen Wort erstellen. Die von diesen KI-Tools verwendeten Trainingsdaten stammen jedoch häufig aus urheberrechtlich geschützten Quellen, insbesondere wenn es um Text-zu-Bild-Generatoren wie DALL-E, Midjourney und andere geht.

Generative KI-Tools zu stoppen, die urheberrechtlich geschützte Bilder zum Trainieren verwenden, ist schwierig, und Künstler aus allen Gesellschaftsschichten haben Mühe, ihre Arbeit vor KI-Trainingsdatensätzen zu schützen. Aber jetzt ändert sich alles mit der Einführung von Nightshade, einem kostenlosen KI-Tool, das entwickelt wurde, um die Ausgabe generativer KI-Tools zu vergiften – und Künstlern endlich die Möglichkeit zu geben, etwas Macht zurückzugewinnen.

Was ist KI-Vergiftung?

Unter KI-Vergiftung versteht man die „Vergiftung“ des Trainingsdatensatzes eines KI-Algorithmus. Dies ähnelt der absichtlichen Übermittlung falscher Informationen an die KI, was dazu führt, dass die trainierte KI nicht richtig funktioniert oder kein Bild erkennt. Tools wie Nightshade verändern die Pixel in einem digitalen Bild so, dass es für das menschliche Auge völlig anders als das darauf trainierte KI-Training erscheint, für das menschliche Auge jedoch weitgehend unverändert vom Original.

Wenn Sie beispielsweise ein vergiftetes Bild eines Autos ins Internet hochladen, wird es für uns Menschen genauso aussehen, aber wie eine KI, die versucht, sich selbst beizubringen, Autos anhand von Bildern von Autos zu identifizieren Im Internet wird man etwas ganz anderes sehen.

Eine ausreichend große Stichprobengröße dieser gefälschten oder verfälschten Bilder in den Trainingsdaten einer KI kann ihre Fähigkeit beeinträchtigen, aus einer bestimmten Eingabeaufforderung genaue Bilder zu generieren, da das Verständnis der KI für das Objekt beeinträchtigt ist.

Es gibt noch einige Fragen zur Zukunft der generativen KI, aber der Schutz originaler digitaler Werke hat definitiv Priorität. Dies kann sogar zukünftige Iterationen des Modells beschädigen, da die Trainingsdaten, auf denen die Grundlage des Modells aufbaut, nicht 100 % korrekt sind.

Mit dieser Technik können digitale Urheber, die der Verwendung ihrer Bilder in KI-Datensätzen nicht zustimmen, diese davor schützen, dass sie ohne Erlaubnis der generativen KI zugeführt werden. Einige Plattformen bieten Erstellern die Möglichkeit, die Aufnahme ihrer Kunstwerke in KI-Trainingsdatensätze abzulehnen. Solche Opt-out-Listen wurden jedoch in der Vergangenheit von KI-Modelltrainern missachtet und werden auch weiterhin ohne oder mit geringen Konsequenzen missachtet.

Im Vergleich zu anderen Tools zum Schutz digitaler Kunstwerke wie Glaze ist Nightshade anstößig. Glaze verhindert, dass KI-Algorithmen den Stil eines bestimmten Bildes nachahmen, während Nightshade das Erscheinungsbild des Bildes an die KI anpasst. Beide Tools wurden von Ben Zhao, Professor für Informatik an der University of Chicago, entwickelt.

So verwenden Sie Nightshade

Der Ersteller des Tools empfiehlt zwar die Verwendung von Nightshade zusammen mit Glaze, es kann jedoch auch als eigenständiges Tool zum Schutz Ihrer Kunstwerke verwendet werden. Auch die Verwendung des Tools ist recht einfach, wenn man bedenkt, dass zum Schutz Ihrer Bilder mit Nightshade nur drei Schritte erforderlich sind.

Es gibt jedoch ein paar Dinge, die Sie beachten müssen, bevor Sie beginnen.

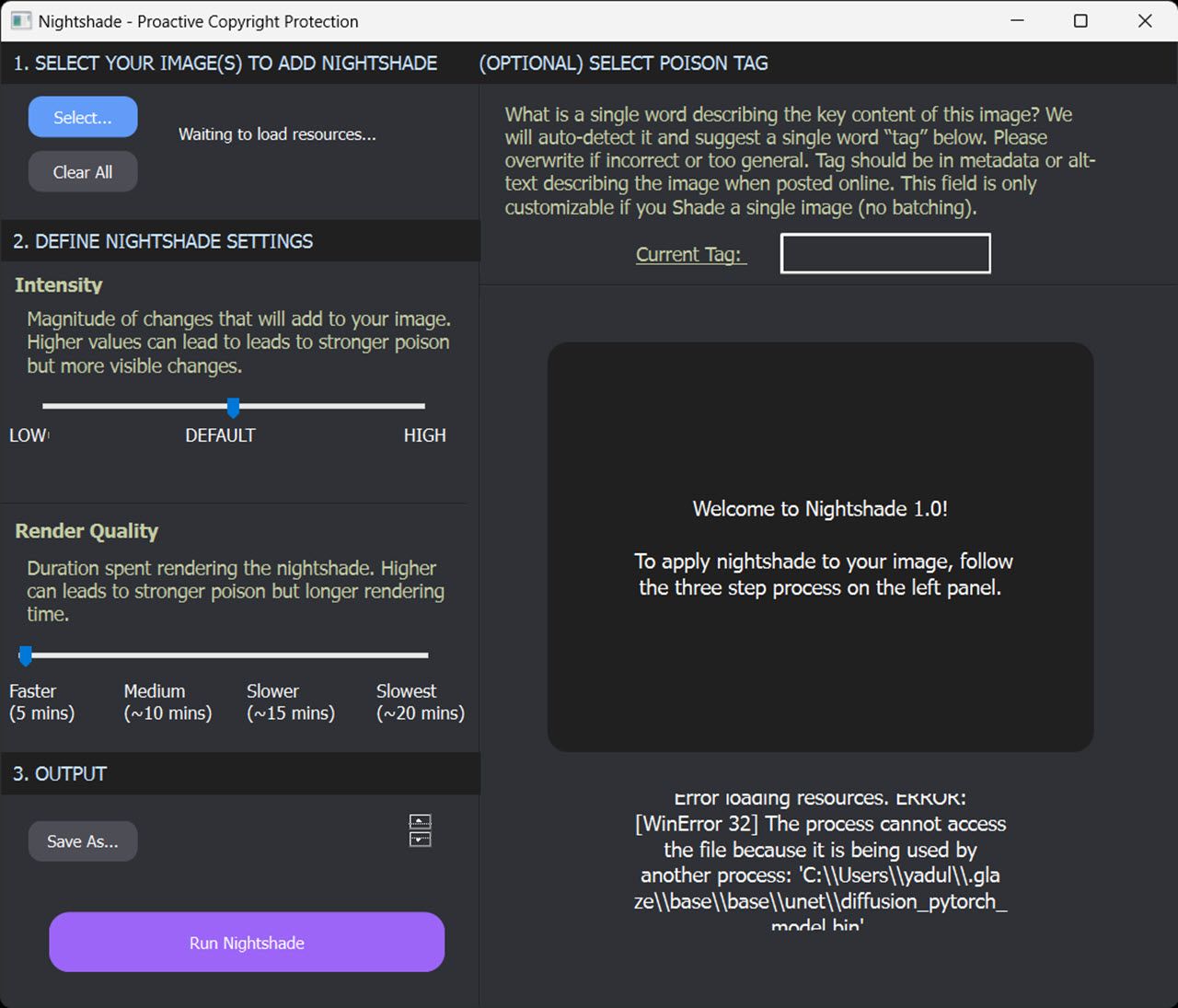

Nightshade ist nur für Windows und MacOS mit eingeschränkter GPU-Unterstützung und mindestens 4 GB VRAM verfügbar. Nicht-Nvidia-GPUs und Intel-Macs werden derzeit nicht unterstützt. Hier ist eine Liste der vom Nightshade-Team unterstützten Nvidia-GPUs (die GTX- und RTX-GPUs finden Sie im Abschnitt „CUDA-fähige GeForce- und TITAN-Produkte“). Alternativ können Sie Nightshade auf Ihrer CPU ausführen, dies führt jedoch zu einer langsameren Leistung. Wenn Sie eine GTX 1660, 1650 oder 1550 haben, kann ein Fehler in der PyTorch-Bibliothek Sie daran hindern, Nightshade ordnungsgemäß zu starten oder zu verwenden. Das Team hinter Nightshade könnte das Problem in Zukunft beheben, indem es von PyTorch auf Tensorflow umsteigt, aber derzeit gibt es keine Problemumgehungen. Das Problem erstreckt sich auch auf die Ti-Varianten dieser Karten. Ich habe das Programm gestartet, indem ich auf meinem Windows 11-PC Administratorzugriff gewährte und einige Minuten wartete, bis es geöffnet wurde. Ihr Kilometerstand kann variieren. Wenn Ihr Kunstwerk viele feste Formen oder Hintergründe aufweist, kann es zu Artefakten kommen. Dem kann durch eine geringere Intensität der „Vergiftung“ entgegengewirkt werden.Was den Schutz Ihrer Bilder mit Nightshade betrifft, müssen Sie Folgendes tun. Beachten Sie, dass in diesem Handbuch die Windows-Version verwendet wird, diese Schritte jedoch auch für die macOS-Version gelten.

Laden Sie die Windows- oder macOS-Version von der Nightshade-Downloadseite herunter. Nightshade wird als archivierter Ordner heruntergeladen, ohne dass eine Installation erforderlich ist. Sobald der Download abgeschlossen ist, extrahieren Sie den ZIP-Ordner und doppelklicken Sie auf Nightshade.exe, um das Programm auszuführen. Wählen Sie das Bild aus, das Sie schützen möchten, indem Sie oben links auf die Schaltfläche „Auswählen“ klicken. Sie können auch mehrere Bilder gleichzeitig für die Stapelverarbeitung auswählen. Passen Sie die Intensitäts- und Renderqualitätsregler nach Ihren Wünschen an. Höhere Werte führen zu einer stärkeren Vergiftung, können aber auch zu Artefakten im Ausgabebild führen. Klicken Sie anschließend im Abschnitt „Ausgabe“ auf die Schaltfläche „Speichern unter“, um ein Ziel für die Ausgabedatei auszuwählen. Klicken Sie unten auf die Schaltfläche „Nightshade ausführen“, um das Programm auszuführen und Ihre Bilder zu verfälschen.

Passen Sie die Intensitäts- und Renderqualitätsregler nach Ihren Wünschen an. Höhere Werte führen zu einer stärkeren Vergiftung, können aber auch zu Artefakten im Ausgabebild führen. Klicken Sie anschließend im Abschnitt „Ausgabe“ auf die Schaltfläche „Speichern unter“, um ein Ziel für die Ausgabedatei auszuwählen. Klicken Sie unten auf die Schaltfläche „Nightshade ausführen“, um das Programm auszuführen und Ihre Bilder zu verfälschen. Optional können Sie auch ein Poison-Tag auswählen. Wenn Sie dies nicht tun, erkennt Nightshade automatisch ein einzelnes Wort-Tag und schlägt es vor. Sie können es jedoch ändern, wenn es falsch oder zu allgemein ist. Beachten Sie, dass diese Einstellung nur verfügbar ist, wenn Sie ein einzelnes Bild in Nightshade verarbeiten.

Wenn alles gut geht, sollten Sie ein Bild erhalten, das für das menschliche Auge genauso aussieht wie das Original, sich aber völlig von einem KI-Algorithmus unterscheidet – und Ihr Kunstwerk vor generativer KI schützt.

-

8 Wesentliche kostenlose und bezahlte API -Empfehlungen für LLMdie Kraft von LLMs nutzen: Ein Leitfaden zu APIs für Großsprachenmodelle In der heutigen dynamischen Geschäftslandschaft revolutionieren APIs (Anwe...KI Gepostet am 2025-04-21

8 Wesentliche kostenlose und bezahlte API -Empfehlungen für LLMdie Kraft von LLMs nutzen: Ein Leitfaden zu APIs für Großsprachenmodelle In der heutigen dynamischen Geschäftslandschaft revolutionieren APIs (Anwe...KI Gepostet am 2025-04-21 -

Benutzerhandbuch: Falcon 3-7B-Anweisungsmodelltii's Falcon 3: Ein revolutionärer Sprung in Open-Source Ai tiis ehrgeiziges Streben nach neu definierender KI erreicht neue Höhen mit dem Adva...KI Gepostet am 2025-04-20

Benutzerhandbuch: Falcon 3-7B-Anweisungsmodelltii's Falcon 3: Ein revolutionärer Sprung in Open-Source Ai tiis ehrgeiziges Streben nach neu definierender KI erreicht neue Höhen mit dem Adva...KI Gepostet am 2025-04-20 -

Deepseek-V3 gegen GPT-4O und Lama 3.3 70b: Das stärkste KI-Modell enthülltThe evolution of AI language models has set new standards, especially in the coding and programming landscape. Leading the c...KI Gepostet am 2025-04-18

Deepseek-V3 gegen GPT-4O und Lama 3.3 70b: Das stärkste KI-Modell enthülltThe evolution of AI language models has set new standards, especially in the coding and programming landscape. Leading the c...KI Gepostet am 2025-04-18 -

Top 5 KI -intelligente Budgeting -ToolsFinanzielle Freiheit mit KI freischalten: Top -Budgeting -Apps in Indien Sind Sie es satt, uns ständig zu fragen, wohin Ihr Geld geht? Scheinen Re...KI Gepostet am 2025-04-17

Top 5 KI -intelligente Budgeting -ToolsFinanzielle Freiheit mit KI freischalten: Top -Budgeting -Apps in Indien Sind Sie es satt, uns ständig zu fragen, wohin Ihr Geld geht? Scheinen Re...KI Gepostet am 2025-04-17 -

Detaillierte Erläuterung der Excel -Summenproduktfunktion - School of Data AnalysisExcels Sumproduktfunktion: Eine Datenanalyse Powerhouse Entsperren Sie die Kraft der Summenproduktfunktion von Excels für die optimierte Datenanaly...KI Gepostet am 2025-04-16

Detaillierte Erläuterung der Excel -Summenproduktfunktion - School of Data AnalysisExcels Sumproduktfunktion: Eine Datenanalyse Powerhouse Entsperren Sie die Kraft der Summenproduktfunktion von Excels für die optimierte Datenanaly...KI Gepostet am 2025-04-16 -

Eingehende Forschung ist vollständig geöffnet, Chatgpt plus BenutzervorteileOpenAs tiefe Forschung: Ein Game-Changer für AI Research OpenAI hat Deep Forschung für alle Chatgpt Plus -Abonnenten ausgelöst und verspricht einen...KI Gepostet am 2025-04-16

Eingehende Forschung ist vollständig geöffnet, Chatgpt plus BenutzervorteileOpenAs tiefe Forschung: Ein Game-Changer für AI Research OpenAI hat Deep Forschung für alle Chatgpt Plus -Abonnenten ausgelöst und verspricht einen...KI Gepostet am 2025-04-16 -

Amazon Nova heute echte Erfahrung und Überprüfung - Analytics VidhyaAmazon enthüllt Nova: Spitzended Foundation-Modelle für verbesserte KI und Inhaltserstellung Amazons jüngster Re: Erfindungs -Ereignis 2024 präse...KI Gepostet am 2025-04-16

Amazon Nova heute echte Erfahrung und Überprüfung - Analytics VidhyaAmazon enthüllt Nova: Spitzended Foundation-Modelle für verbesserte KI und Inhaltserstellung Amazons jüngster Re: Erfindungs -Ereignis 2024 präse...KI Gepostet am 2025-04-16 -

5 Möglichkeiten zur Verwendung von ChatGPT -Timing -AufgabenfunktionCHATGPTS neue geplante Aufgaben: Automatisieren Sie Ihren Tag mit ai chatgpt hat kürzlich eine bahnbrechende Funktion vorgestellt: geplante Aufgabe...KI Gepostet am 2025-04-16

5 Möglichkeiten zur Verwendung von ChatGPT -Timing -AufgabenfunktionCHATGPTS neue geplante Aufgaben: Automatisieren Sie Ihren Tag mit ai chatgpt hat kürzlich eine bahnbrechende Funktion vorgestellt: geplante Aufgabe...KI Gepostet am 2025-04-16 -

Welche der drei AI -Chatbots reagieren auf dieselbe Eingabeaufforderung am besten?mit Optionen wie Claude, Chatgpt und Gemini können sich ein Chatbot auswählen, das sich überwältigend fühlen kann. Um das Geräusch zu durchschneid...KI Gepostet am 2025-04-15

Welche der drei AI -Chatbots reagieren auf dieselbe Eingabeaufforderung am besten?mit Optionen wie Claude, Chatgpt und Gemini können sich ein Chatbot auswählen, das sich überwältigend fühlen kann. Um das Geräusch zu durchschneid...KI Gepostet am 2025-04-15 -

Chatgpt ist genug, es wird kein dedizierter KI -Chat -Computer benötigtIn einer Welt mit neuen KI -Chatbots, die täglich starten, kann es überwältigend sein, zu entscheiden, welches das richtige „eins“ ist. Aber meiner E...KI Gepostet am 2025-04-14

Chatgpt ist genug, es wird kein dedizierter KI -Chat -Computer benötigtIn einer Welt mit neuen KI -Chatbots, die täglich starten, kann es überwältigend sein, zu entscheiden, welches das richtige „eins“ ist. Aber meiner E...KI Gepostet am 2025-04-14 -

Indischer KI -Moment: Wettbewerb mit China und den Vereinigten Staaten in Generativen KIIndiens KI -Ambitionen: A 2025 Update Mit China und den USA, die stark in generative KI investieren, beschleunigt Indien seine eigenen Genai -Initi...KI Gepostet am 2025-04-13

Indischer KI -Moment: Wettbewerb mit China und den Vereinigten Staaten in Generativen KIIndiens KI -Ambitionen: A 2025 Update Mit China und den USA, die stark in generative KI investieren, beschleunigt Indien seine eigenen Genai -Initi...KI Gepostet am 2025-04-13 -

Automatisierung des Imports von CSV in PostgreSQL mit AirFlow und DockerDieses Tutorial zeigt, dass das Erstellen einer robusten Datenpipeline mit Apache Airstrow, Docker und PostgreSQL erstellt wird, um die Datenübertrag...KI Gepostet am 2025-04-12

Automatisierung des Imports von CSV in PostgreSQL mit AirFlow und DockerDieses Tutorial zeigt, dass das Erstellen einer robusten Datenpipeline mit Apache Airstrow, Docker und PostgreSQL erstellt wird, um die Datenübertrag...KI Gepostet am 2025-04-12 -

Swarm Intelligence Algorithmen: Drei Python -ImplementierungenImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...KI Gepostet am 2025-03-24

Swarm Intelligence Algorithmen: Drei Python -ImplementierungenImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...KI Gepostet am 2025-03-24 -

So machen Sie Ihre LLM mit Rag & Fine-Tuning genauerImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...KI Gepostet am 2025-03-24

So machen Sie Ihre LLM mit Rag & Fine-Tuning genauerImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...KI Gepostet am 2025-03-24 -

Was ist Google Gemini? Alles, was Sie über den Chatgpt -Rivalen von Google wissen müssenGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...KI Gepostet am 2025-03-23

Was ist Google Gemini? Alles, was Sie über den Chatgpt -Rivalen von Google wissen müssenGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...KI Gepostet am 2025-03-23

Chinesisch lernen

- 1 Wie sagt man „gehen“ auf Chinesisch? 走路 Chinesische Aussprache, 走路 Chinesisch lernen

- 2 Wie sagt man auf Chinesisch „Flugzeug nehmen“? 坐飞机 Chinesische Aussprache, 坐飞机 Chinesisch lernen

- 3 Wie sagt man auf Chinesisch „einen Zug nehmen“? 坐火车 Chinesische Aussprache, 坐火车 Chinesisch lernen

- 4 Wie sagt man auf Chinesisch „Bus nehmen“? 坐车 Chinesische Aussprache, 坐车 Chinesisch lernen

- 5 Wie sagt man „Fahren“ auf Chinesisch? 开车 Chinesische Aussprache, 开车 Chinesisch lernen

- 6 Wie sagt man Schwimmen auf Chinesisch? 游泳 Chinesische Aussprache, 游泳 Chinesisch lernen

- 7 Wie sagt man auf Chinesisch „Fahrrad fahren“? 骑自行车 Chinesische Aussprache, 骑自行车 Chinesisch lernen

- 8 Wie sagt man auf Chinesisch Hallo? 你好Chinesische Aussprache, 你好Chinesisch lernen

- 9 Wie sagt man „Danke“ auf Chinesisch? 谢谢Chinesische Aussprache, 谢谢Chinesisch lernen

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning