Titelseite > KI > Jenseits von LLMs: Hier erfahren Sie, warum kleine Sprachmodelle die Zukunft der KI sind

Titelseite > KI > Jenseits von LLMs: Hier erfahren Sie, warum kleine Sprachmodelle die Zukunft der KI sind

Jenseits von LLMs: Hier erfahren Sie, warum kleine Sprachmodelle die Zukunft der KI sind

Mit der Veröffentlichung von ChatGPT von Open AI kamen große Sprachmodelle (LLMs) auf den Markt. Seitdem haben mehrere Unternehmen auch ihre LLMs eingeführt, aber immer mehr Unternehmen tendieren zu kleinen Sprachmodellen (SLMs).

SLMs gewinnen an Bedeutung, aber was sind sie und wie unterscheiden sie sich von LLMs?

Was ist ein kleines Sprachmodell?

Ein kleines Sprachmodell (SLM) ist eine Art Modell der künstlichen Intelligenz mit weniger Parametern (stellen Sie sich dies als einen Wert im Modell vor, der während des Trainings gelernt wurde). Wie ihre größeren Gegenstücke können SLMs Text generieren und andere Aufgaben ausführen. Allerdings verwenden SLMs weniger Datensätze für das Training, verfügen über weniger Parameter und erfordern weniger Rechenleistung zum Trainieren und Ausführen.

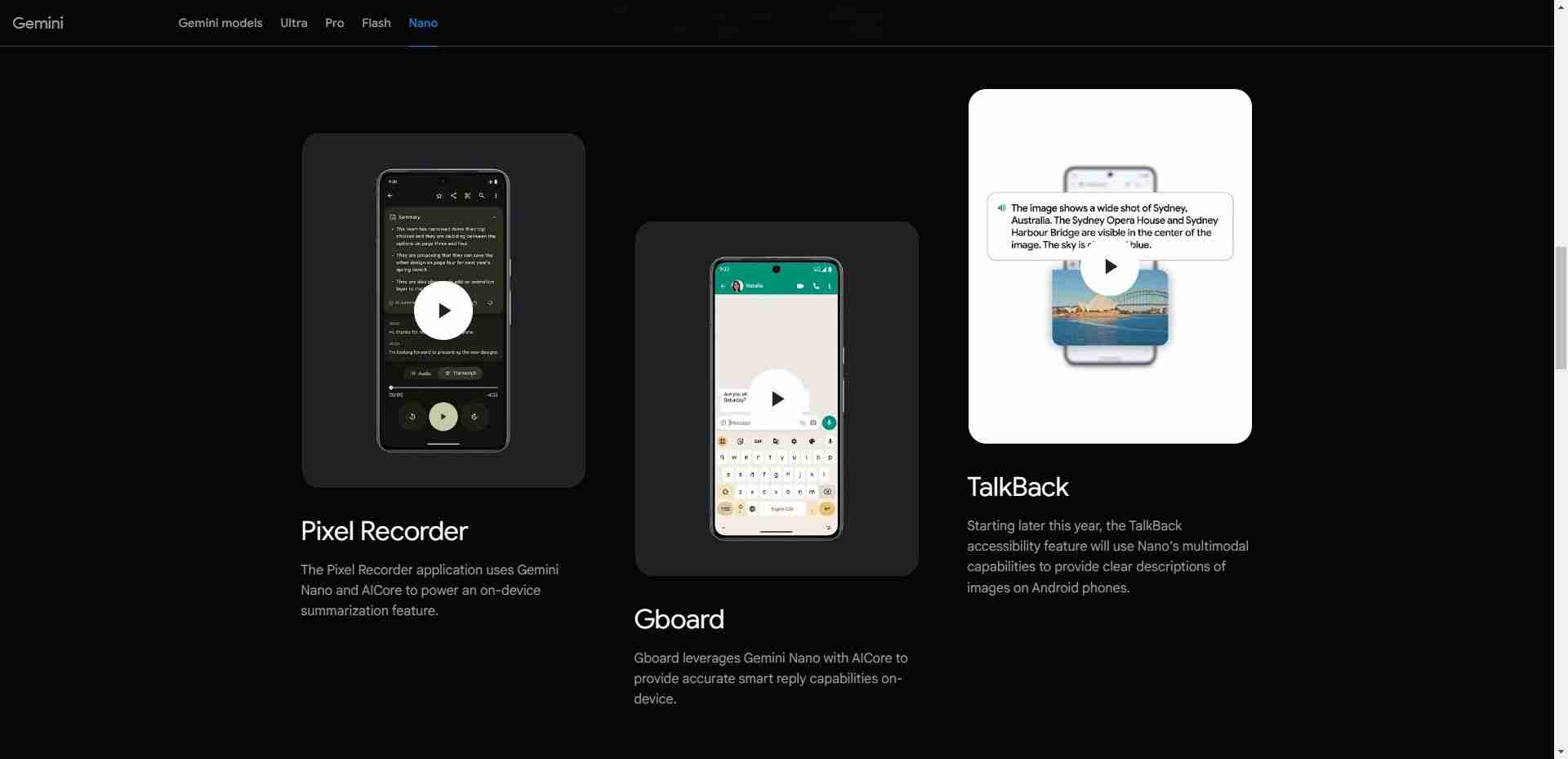

SLMs konzentrieren sich auf Schlüsselfunktionen und ihr geringer Platzbedarf bedeutet, dass sie auf verschiedenen Geräten, einschließlich diesen, bereitgestellt werden können die nicht über High-End-Hardware wie Mobilgeräte verfügen. Googles Nano beispielsweise ist ein von Grund auf neu entwickeltes On-Device-SLM, das auf Mobilgeräten läuft. Aufgrund seiner geringen Größe kann Nano nach Angaben des Unternehmens lokal mit oder ohne Netzwerkkonnektivität ausgeführt werden.

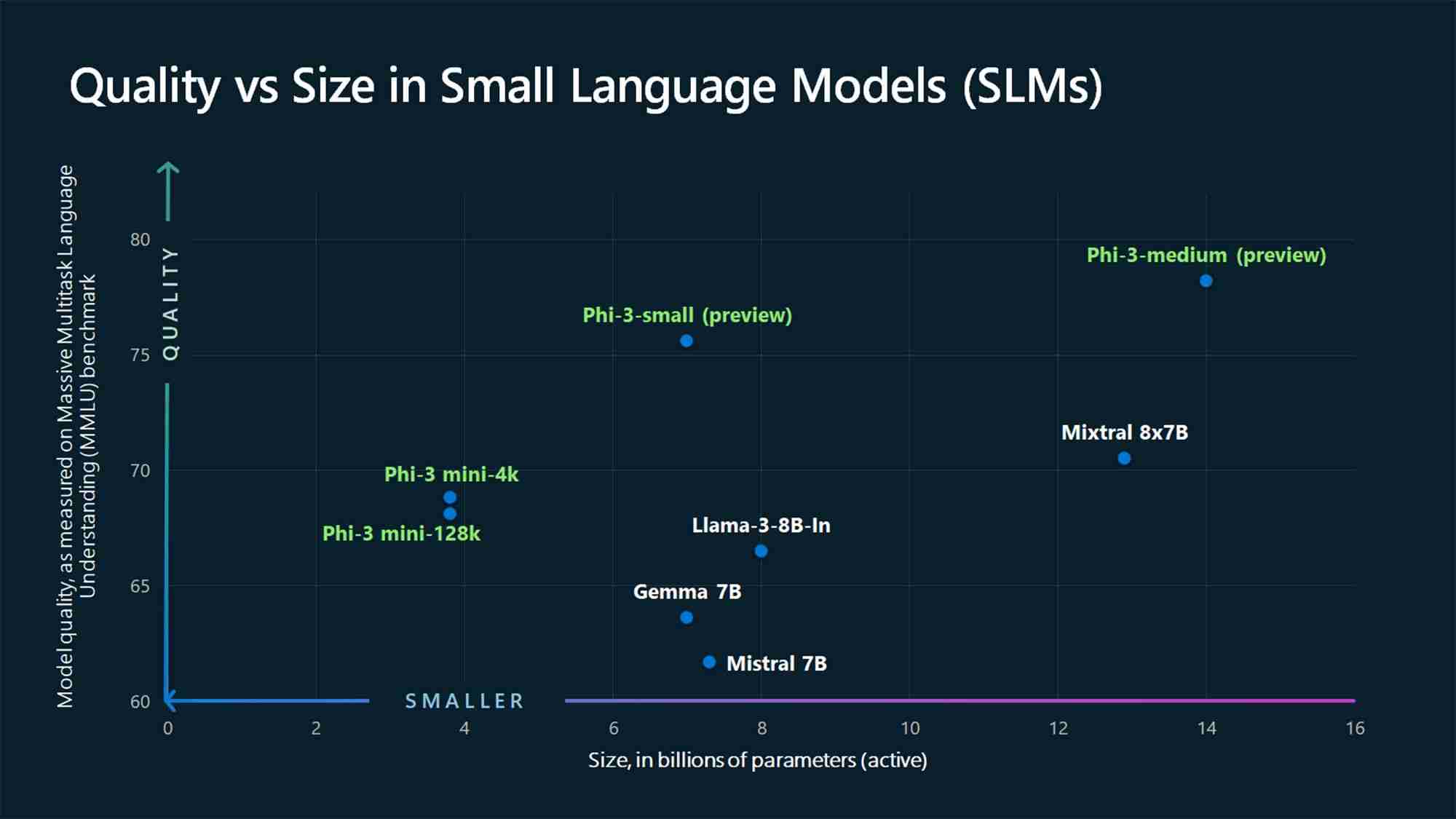

Neben Nano gibt es viele andere SLMs von führenden und aufstrebenden Unternehmen im KI-Bereich. Zu den beliebten SLMs gehören Phi-3 von Microsoft, GPT-4o mini von OpenAI, Claude 3 Haiku von Anthropic, Llama 3 von Meta und Mixtral 8x7B von Mistral AI.

Es sind auch andere Optionen verfügbar, die Sie vielleicht für LLMs halten, es aber sind SLMs. Dies gilt insbesondere, wenn man bedenkt, dass die meisten Unternehmen den Multi-Modell-Ansatz verfolgen und mehr als ein Sprachmodell in ihrem Portfolio veröffentlichen und sowohl LLMs als auch SLMs anbieten. Ein Beispiel ist GPT-4, das über verschiedene Modelle verfügt, darunter GPT-4, GPT-4o (Omni) und GPT-4o mini.

Kleine Sprachmodelle vs. große Sprachmodelle

Bei der Diskussion über SLMs können wir ihre großen Gegenstücke nicht außer Acht lassen: LLMs. Der Hauptunterschied zwischen einem SLM und einem LLM ist die Modellgröße, die anhand von Parametern gemessen wird.

Zum jetzigen Zeitpunkt besteht in der KI-Branche kein Konsens darüber, wie viele Parameter ein Modell maximal nicht haben sollte überschreiten, um als SLM zu gelten, oder die Mindestanzahl, die erforderlich ist, um als LLM zu gelten. Allerdings verfügen SLMs in der Regel über Millionen bis einige Milliarden Parameter, während LLMs über mehr und sogar Billionen verfügen.

Zum Beispiel verfügt GPT-3, das im Jahr 2020 veröffentlicht wurde, über 175 Milliarden Parameter (und die Es wird gemunkelt, dass das GPT-4-Modell rund 1,76 Billionen hat, während die 2024 Phi-3-mini, Phi-3-small und Phi-3-medium SLMs von Microsoft jeweils 3,8, 7 und 14 Milliarden Parameter messen.

Ein weiterer Unterscheidungsfaktor zwischen SLMs und LLMs ist die Menge der für das Training verwendeten Daten. SLMs werden auf kleineren Datenmengen trainiert, während LLMs große Datensätze verwenden. Dieser Unterschied wirkt sich auch auf die Fähigkeit des Modells aus, komplexe Aufgaben zu lösen.

Aufgrund der großen Datenmenge, die beim Training verwendet wird, eignen sich LLMs besser für die Lösung verschiedener Arten komplexer Aufgaben, die fortgeschrittenes Denken erfordern, während SLMs besser für einfachere Aufgaben geeignet sind Aufgaben. Im Gegensatz zu LLMs verwenden SLMs weniger Trainingsdaten, aber die verwendeten Daten müssen von höherer Qualität sein, um viele der in LLMs enthaltenen Funktionen in einem winzigen Paket zu erreichen.

Warum kleine Sprachmodelle die Zukunft sind

Für die meisten Anwendungsfälle sind SLMs besser positioniert, um zu den Mainstream-Modellen zu werden, die von Unternehmen und Verbrauchern zur Ausführung einer Vielzahl von Aufgaben verwendet werden. Klar, LLMs haben ihre Vorteile und sind für bestimmte Anwendungsfälle, etwa die Lösung komplexer Aufgaben, besser geeignet. Allerdings sind SLMs aus den folgenden Gründen für die meisten Anwendungsfälle die Zukunft.

1. Geringere Schulungs- und Wartungskosten

SLMs benötigen weniger Daten für das Training als LLMs, was sie ausmacht die praktikabelste Option für Einzelpersonen und kleine bis mittlere Unternehmen mit begrenzten Schulungsdaten, Finanzen oder beidem. LLMs erfordern große Mengen an Trainingsdaten und damit auch enorme Rechenressourcen für das Training und den Betrieb.

Um dies ins rechte Licht zu rücken: Sam Altman, CEO von OpenAI, bestätigte, dass das Training mehr als 100 Millionen US-Dollar gekostet hat GPT-4 während einer Rede auf einer Veranstaltung am MIT (laut Wired). Ein weiteres Beispiel ist Metas OPT-175B LLM. Laut Meta wurde das Training mit 992 NVIDIA A100 80-GB-GPUs durchgeführt, die laut CNBC etwa 10.000 US-Dollar pro Einheit kosten. Damit belaufen sich die Kosten auf etwa 9 Millionen US-Dollar, ohne weitere Ausgaben wie Energie, Gehälter und mehr.

Bei solchen Zahlen ist es für kleine und mittlere Unternehmen nicht rentabel, einen LLM auszubilden. Im Gegensatz dazu haben SLMs in Bezug auf die Ressourcen eine geringere Eintrittsbarriere und sind kostengünstiger im Betrieb, sodass mehr Unternehmen sie nutzen werden.

2. Bessere Leistung

Leistung ist ein weiterer Aspekt Bereich, in dem SLMs LLMs aufgrund ihrer kompakten Größe schlagen. SLMs haben eine geringere Latenz und eignen sich besser für Szenarien, in denen schnellere Reaktionen erforderlich sind, beispielsweise in Echtzeitanwendungen. Beispielsweise wird in Sprachantwortsystemen wie digitalen Assistenten eine schnellere Reaktion bevorzugt.

Die Ausführung auf dem Gerät (mehr dazu später) bedeutet auch, dass Ihre Anfrage nicht den Weg zu Online-Servern und zurück zurücklegen muss Reagieren Sie auf Ihre Anfrage, was zu schnelleren Antworten führt.

3. Genauer

Wenn es um generative KI geht, bleibt eines konstant: Müll rein, Müll raus. Aktuelle LLMs wurden mithilfe großer Datensätze roher Internetdaten trainiert. Daher sind sie möglicherweise nicht in allen Situationen genau. Dies ist eines der Probleme von ChatGPT und ähnlichen Modellen und der Grund, warum Sie nicht allem vertrauen sollten, was ein KI-Chatbot sagt. Andererseits werden SLMs mit höherwertigen Daten trainiert als LLMs und weisen daher eine höhere Genauigkeit auf.

SLMs können auch durch gezieltes Training auf bestimmte Aufgaben oder Domänen weiter verfeinert werden, was zu einer besseren Genauigkeit in diesen führt Bereiche im Vergleich zu größeren, allgemeineren Modellen.

4. Kann auf dem Gerät ausgeführt werden

SLMs benötigen weniger Rechenleistung als LLMs und sind daher ideal für Edge-Computing-Fälle. Sie können auf Edge-Geräten wie Smartphones und autonomen Fahrzeugen eingesetzt werden, die nicht über große Rechenleistung oder Ressourcen verfügen. Das Nano-Modell von Google kann auf dem Gerät ausgeführt werden, sodass es auch dann funktioniert, wenn Sie keine aktive Internetverbindung haben.

Diese Fähigkeit stellt eine Win-Win-Situation sowohl für Unternehmen als auch für Verbraucher dar. Erstens ist es ein Gewinn für den Datenschutz, da Benutzerdaten lokal verarbeitet und nicht an die Cloud gesendet werden, was wichtig ist, da in unseren Smartphones mehr KI integriert ist, die nahezu jedes Detail über uns enthält. Es ist auch ein Gewinn für Unternehmen, da sie keine großen Server bereitstellen und betreiben müssen, um KI-Aufgaben zu bewältigen.

SLMs gewinnen an Dynamik, wobei die größten Branchenakteure wie Open AI, Google, Microsoft, Anthropic und Meta veröffentlichen solche Modelle. Diese Modelle eignen sich eher für einfachere Aufgaben, wofür die meisten von uns LLMs verwenden; Daher sind sie die Zukunft.

Aber LLMs führen nirgendwo hin. Stattdessen werden sie für fortschrittliche Anwendungen verwendet, die Informationen aus verschiedenen Bereichen kombinieren, um etwas Neues zu schaffen, wie etwa in der medizinischen Forschung.

-

Swarm Intelligence Algorithmen: Drei Python -ImplementierungenImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...KI Gepostet am 2025-03-24

Swarm Intelligence Algorithmen: Drei Python -ImplementierungenImagine watching a flock of birds in flight. There's no leader, no one giving directions, yet they swoop and glide together in perfect harmony. It may...KI Gepostet am 2025-03-24 -

So machen Sie Ihre LLM mit Rag & Fine-Tuning genauerImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...KI Gepostet am 2025-03-24

So machen Sie Ihre LLM mit Rag & Fine-Tuning genauerImagine studying a module at university for a semester. At the end, after an intensive learning phase, you take an exam – and you can recall th...KI Gepostet am 2025-03-24 -

Was ist Google Gemini? Alles, was Sie über den Chatgpt -Rivalen von Google wissen müssenGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...KI Gepostet am 2025-03-23

Was ist Google Gemini? Alles, was Sie über den Chatgpt -Rivalen von Google wissen müssenGoogle recently released its new Generative AI model, Gemini. It results from a collaborative effort by a range of teams at Google, including members ...KI Gepostet am 2025-03-23 -

Leitfaden zur Aufforderung mit DSPYDSPY: Ein deklaratives Rahmen zum Aufbau und zur Verbesserung von LLM -Anwendungen DSPY (deklarative selbstverbesserte Sprachprogramme) revolutioni...KI Gepostet am 2025-03-22

Leitfaden zur Aufforderung mit DSPYDSPY: Ein deklaratives Rahmen zum Aufbau und zur Verbesserung von LLM -Anwendungen DSPY (deklarative selbstverbesserte Sprachprogramme) revolutioni...KI Gepostet am 2025-03-22 -

Automatisieren Sie den Blog zum Twitter -ThreadDieser Artikel beschreibt die Automatisierung der Konvertierung von Langforminhalten (wie Blog-Posts) in Twitter-Threads mithilfe von Googles Gemini-...KI Gepostet am 2025-03-11

Automatisieren Sie den Blog zum Twitter -ThreadDieser Artikel beschreibt die Automatisierung der Konvertierung von Langforminhalten (wie Blog-Posts) in Twitter-Threads mithilfe von Googles Gemini-...KI Gepostet am 2025-03-11 -

Künstliches Immunsystem (AIS): Ein Leitfaden mit Python -BeispielenIn diesem Artikel werden künstliche Immunsysteme (AIS) untersucht, die von der bemerkenswerten Fähigkeit des menschlichen Immunsystems inspiriert wur...KI Gepostet am 2025-03-04

Künstliches Immunsystem (AIS): Ein Leitfaden mit Python -BeispielenIn diesem Artikel werden künstliche Immunsysteme (AIS) untersucht, die von der bemerkenswerten Fähigkeit des menschlichen Immunsystems inspiriert wur...KI Gepostet am 2025-03-04 -

Versuchen Sie, ChatGPT diese lustigen Fragen über sich selbst zu stellenHaben Sie sich jemals gefragt, was ChatGPT über Sie weiß? Wie verarbeitet es die Informationen, die Sie ihm im Laufe der Zeit zugeführt haben? Ich hab...KI Veröffentlicht am 22.11.2024

Versuchen Sie, ChatGPT diese lustigen Fragen über sich selbst zu stellenHaben Sie sich jemals gefragt, was ChatGPT über Sie weiß? Wie verarbeitet es die Informationen, die Sie ihm im Laufe der Zeit zugeführt haben? Ich hab...KI Veröffentlicht am 22.11.2024 -

So können Sie den mysteriösen GPT-2-Chatbot trotzdem ausprobierenWenn Sie sich für KI-Modelle oder Chatbots interessieren, haben Sie vielleicht Diskussionen über den mysteriösen GPT-2-Chatbot und seine Wirksamkeit g...KI Veröffentlicht am 08.11.2024

So können Sie den mysteriösen GPT-2-Chatbot trotzdem ausprobierenWenn Sie sich für KI-Modelle oder Chatbots interessieren, haben Sie vielleicht Diskussionen über den mysteriösen GPT-2-Chatbot und seine Wirksamkeit g...KI Veröffentlicht am 08.11.2024 -

Der Canvas-Modus von ChatGPT ist großartig: Dies sind 4 Möglichkeiten, ihn zu verwendenDer neue Canvas-Modus von ChatGPT hat dem Schreiben und Bearbeiten im weltweit führenden generativen KI-Tool eine zusätzliche Dimension hinzugefügt. I...KI Veröffentlicht am 08.11.2024

Der Canvas-Modus von ChatGPT ist großartig: Dies sind 4 Möglichkeiten, ihn zu verwendenDer neue Canvas-Modus von ChatGPT hat dem Schreiben und Bearbeiten im weltweit führenden generativen KI-Tool eine zusätzliche Dimension hinzugefügt. I...KI Veröffentlicht am 08.11.2024 -

Wie die benutzerdefinierten GPTs von ChatGPT Ihre Daten preisgeben könnten und wie Sie sie schützen könnenMit der benutzerdefinierten GPT-Funktion von ChatGPT kann jeder ein benutzerdefiniertes KI-Tool für fast alles erstellen, was Ihnen einfällt. Kreativ...KI Veröffentlicht am 08.11.2024

Wie die benutzerdefinierten GPTs von ChatGPT Ihre Daten preisgeben könnten und wie Sie sie schützen könnenMit der benutzerdefinierten GPT-Funktion von ChatGPT kann jeder ein benutzerdefiniertes KI-Tool für fast alles erstellen, was Ihnen einfällt. Kreativ...KI Veröffentlicht am 08.11.2024 -

10 Möglichkeiten, wie ChatGPT Ihnen helfen kann, einen Job auf LinkedIn zu findenMit 2.600 verfügbaren Zeichen ist der Abschnitt „Info“ Ihres LinkedIn-Profils ein großartiger Ort, um Ihren Hintergrund, Ihre Fähigkeiten, Leidenscha...KI Veröffentlicht am 08.11.2024

10 Möglichkeiten, wie ChatGPT Ihnen helfen kann, einen Job auf LinkedIn zu findenMit 2.600 verfügbaren Zeichen ist der Abschnitt „Info“ Ihres LinkedIn-Profils ein großartiger Ort, um Ihren Hintergrund, Ihre Fähigkeiten, Leidenscha...KI Veröffentlicht am 08.11.2024 -

Schauen Sie sich diese 6 weniger bekannten KI-Apps an, die einzigartige Erlebnisse bietenZu diesem Zeitpunkt haben die meisten Leute von ChatGPT und Copilot gehört, zwei bahnbrechenden generativen KI-Apps, die den KI-Boom angeführt haben.A...KI Veröffentlicht am 08.11.2024

Schauen Sie sich diese 6 weniger bekannten KI-Apps an, die einzigartige Erlebnisse bietenZu diesem Zeitpunkt haben die meisten Leute von ChatGPT und Copilot gehört, zwei bahnbrechenden generativen KI-Apps, die den KI-Boom angeführt haben.A...KI Veröffentlicht am 08.11.2024 -

Diese 7 Zeichen zeigen, dass wir den KI-Höhepunkt bereits erreicht habenWo auch immer Sie online suchen, es gibt Websites, Dienste und Apps, die behaupten, dass der Einsatz von KI die beste Option sei. Ich weiß nicht, wie ...KI Veröffentlicht am 08.11.2024

Diese 7 Zeichen zeigen, dass wir den KI-Höhepunkt bereits erreicht habenWo auch immer Sie online suchen, es gibt Websites, Dienste und Apps, die behaupten, dass der Einsatz von KI die beste Option sei. Ich weiß nicht, wie ...KI Veröffentlicht am 08.11.2024 -

4 KI-überprüfende ChatGPT-Detektor-Tools für Lehrer, Dozenten und VorgesetzteJe leistungsfähiger ChatGPT wird, desto schwieriger wird es zu erkennen, was von einem Menschen geschrieben und was von einer KI generiert wird. Dies...KI Veröffentlicht am 08.11.2024

4 KI-überprüfende ChatGPT-Detektor-Tools für Lehrer, Dozenten und VorgesetzteJe leistungsfähiger ChatGPT wird, desto schwieriger wird es zu erkennen, was von einem Menschen geschrieben und was von einer KI generiert wird. Dies...KI Veröffentlicht am 08.11.2024 -

Die erweiterte Sprachfunktion von ChatGPT wird für mehr Benutzer eingeführtWenn Sie schon immer ein umfassendes Gespräch mit ChatGPT führen wollten, können Sie dies jetzt tun. Das heißt, solange Sie für das Privileg der Nutzu...KI Veröffentlicht am 08.11.2024

Die erweiterte Sprachfunktion von ChatGPT wird für mehr Benutzer eingeführtWenn Sie schon immer ein umfassendes Gespräch mit ChatGPT führen wollten, können Sie dies jetzt tun. Das heißt, solange Sie für das Privileg der Nutzu...KI Veröffentlicht am 08.11.2024

Chinesisch lernen

- 1 Wie sagt man „gehen“ auf Chinesisch? 走路 Chinesische Aussprache, 走路 Chinesisch lernen

- 2 Wie sagt man auf Chinesisch „Flugzeug nehmen“? 坐飞机 Chinesische Aussprache, 坐飞机 Chinesisch lernen

- 3 Wie sagt man auf Chinesisch „einen Zug nehmen“? 坐火车 Chinesische Aussprache, 坐火车 Chinesisch lernen

- 4 Wie sagt man auf Chinesisch „Bus nehmen“? 坐车 Chinesische Aussprache, 坐车 Chinesisch lernen

- 5 Wie sagt man „Fahren“ auf Chinesisch? 开车 Chinesische Aussprache, 开车 Chinesisch lernen

- 6 Wie sagt man Schwimmen auf Chinesisch? 游泳 Chinesische Aussprache, 游泳 Chinesisch lernen

- 7 Wie sagt man auf Chinesisch „Fahrrad fahren“? 骑自行车 Chinesische Aussprache, 骑自行车 Chinesisch lernen

- 8 Wie sagt man auf Chinesisch Hallo? 你好Chinesische Aussprache, 你好Chinesisch lernen

- 9 Wie sagt man „Danke“ auf Chinesisch? 谢谢Chinesische Aussprache, 谢谢Chinesisch lernen

- 10 How to say goodbye in Chinese? 再见Chinese pronunciation, 再见Chinese learning